Seu sistema operacional de IA pessoal.

Não é um chatbot que você abre. É uma IA que está sempre ativa, sempre observando. Dê um nome. Modele-a. Conecte-a a tudo que você usa. Acesse-a como quiser trabalhar. Código aberto, auto-hospedado, seu para sempre.

Veja em ação

Veja o CORE pegar uma tarefa em texto simples, coletar contexto do GitHub e memória, planejar o trabalho, rodar uma sessão do Claude Code e abrir um PR:

Sempre observando. Sempre pronto.

A maioria das ferramentas de IA espera ser chamada. O CORE observa.

Conecte-o aos seus aplicativos e ele monitora a atividade em todos eles. Chega um e-mail de um cliente, uma issue do GitHub é atribuída, um alerta do Sentry dispara, uma reunião termina. O CORE vê, verifica sua memória e as habilidades configuradas, e lida ou encaminha para seu julgamento. Você não o aciona. Ele percebe sozinho.

Instale o plugin CORE no Claude Code, Codex ou Cursor e suas conversas de agentes também serão monitoradas. Contexto discutido, decisões tomadas, código escrito, tudo alimenta o grafo de conhecimento da memória. A próxima tarefa que o CORE pegar já saberá o que aconteceu na sua última sessão.

Quando atua, atua diretamente. Pode responder e-mails, atualizar issues no Linear, criar PRs no GitHub, enviar mensagens no Slack, executar comandos no terminal, controlar um navegador e iniciar uma sessão do Claude Code ou Codex de qualquer interface. Envie uma mensagem pelo WhatsApp no aeroporto e o CORE pode ter uma sessão de codificação rodando e um PR aberto antes de você embarcar.

Você decide onde ele age por conta própria e onde espera pelo seu chamado. Lide automaticamente com alertas do Sentry, mas sempre peça confirmação antes de realizar merge. Aprove um plano antes de iniciar uma sessão de codificação. Exija confirmação antes de enviar qualquer e-mail. O nível de autonomia é seu para definir, por tarefa, por aplicativo, por ação.

Quatro maneiras de acessá-lo

Um chatbot tem uma interface. Um sistema operacional tem várias.

Voz. Pressione Ctrl+Option no Mac e diga o que precisa ser feito. O CORE executa em segundo plano sem interromper seu fluxo.

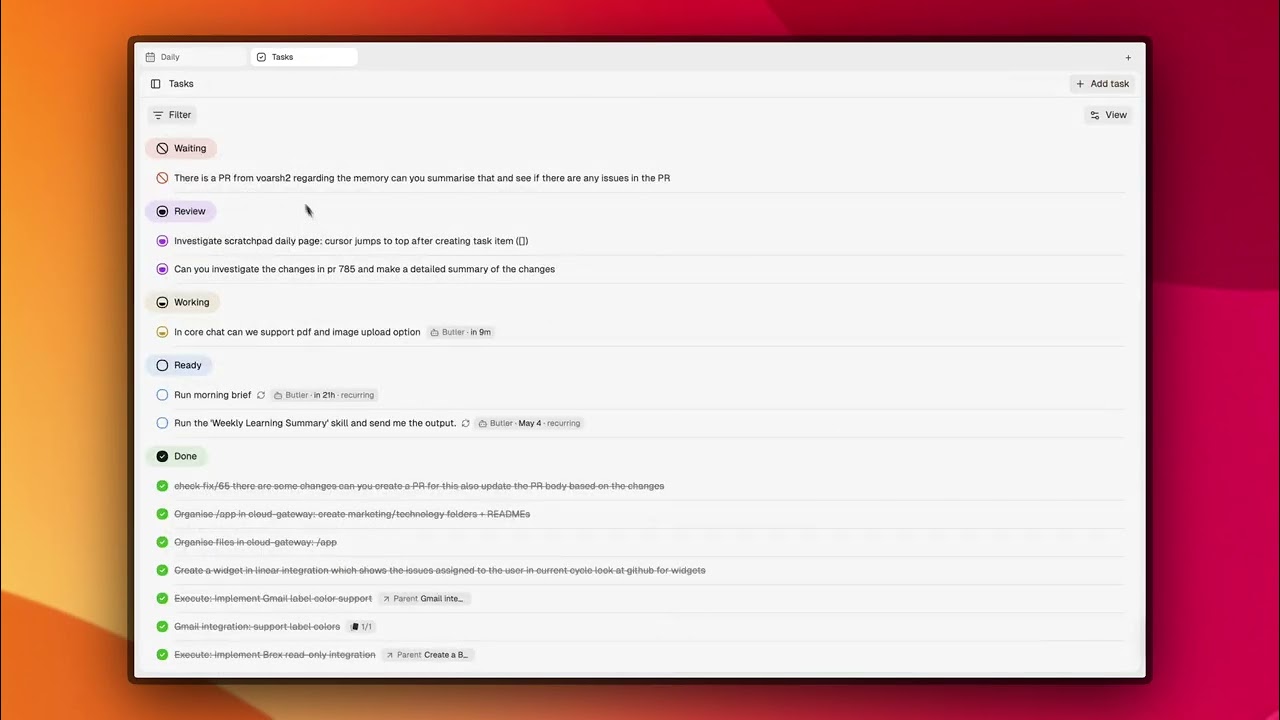

Rascunho. Abra sua página diária e escreva [ ] Corrigir o bug de autenticação do issue #47. O CORE detecta em até 3 minutos, carrega o contexto do seu repositório e memória, e elabora um plano.

Mensagens. WhatsApp, Slack, Telegram. Envie uma tarefa do aeroporto, do celular, da cama. O CORE tem seu contexto completo, independentemente de onde a mensagem venha.

Chat. Abra o painel e converse diretamente, como qualquer assistente. Quando quiser um diálogo antes de delegar.

Uma IA, quatro superfícies, a mesma memória e contexto por trás de todas.

Personalize como quiser

Dê um nome. Escolha como ele fala. Defina as regras que ele seguirá em qualquer lugar.

Escolha entre cinco personalidades embutidas — eficiência seca de TARS, formalidade leal de Alfred, praticidade calorosa de Hudson — ou crie a sua própria. A personalidade estará em cada tarefa executada, cada plano elaborado, cada mensagem enviada em seu nome.

Escolha sua voz para interações faladas. A partir daí, ele soa e se comporta como a IA que você configurou, em todas as interfaces.

CORE em ação

Diga, volte para um PR.

Pressione Ctrl+Option, fale: "Corrija a condição de corrida no fluxo de checkout do issue #312."

O CORE carrega o issue, puxa commits relacionados e conversas do Slack, elabora um plano e inicia uma sessão Claude Code. Você volta para um diff. Você nunca esteve na sua mesa.

Escreva à noite, revise pela manhã.

Bloco de notas: [ ] Trabalhar no backlog de hoje à noite a partir das 23h

CORE extrai informações do Linear, GitHub e da memória, prioriza e executa enquanto você dorme. Execuções suaves aguardam sua revisão. Sessões travadas retornam com uma pergunta objetiva, não com uma aba parada.

Envie mensagens de qualquer lugar.

WhatsApp do aeroporto: "Faça o deploy do refactor de autenticação."

O CORE já sabe o branch, o contexto e suas preferências. Está rodando no Railway. Inicia a sessão antes de você embarcar.

Investigue alertas antes que virem incidentes.

Sentry dispara às 2h. O CORE investiga, busca rastros e incidentes anteriores na memória, propõe uma correção e te avisa no Slack: "Issue #847, correção proposta, aguardando sua revisão." Você aprova pelo celular.

Receba um resumo que já entende sua semana.

Tarefa recorrente, toda manhã às 8h. O CORE busca em e-mail, GitHub, Linear e Slack, mostra só o que realmente precisa de atenção, ignora o resto e transforma follow-ups em tarefas automaticamente.

O que está dentro do CORE

| | | |---|---| | Memória | Grafo temporal de conhecimento em todas as ferramentas e conversas. Preferências, decisões, metas e diretrizes, para que cada tarefa comece com contexto carregado. | | Tarefas | Unidades de trabalho pontuais ou recorrentes com sua especificação, plano do CORE, estado ao vivo e um chat dedicado. Cada tarefa pode gerar sessões de código, navegador ou terminal. | | Conectores | Mais de 50 apps por um único endpoint MCP, além de gatilhos webhook para automação proativa. GitHub, Linear, Jira, Slack, Gmail, Agenda, Sentry, Notion, Todoist e mais. | | Skills | Instruções reutilizáveis que disparam automaticamente de acordo com o contexto. Exemplo: "sempre busque issues relacionadas no Linear antes de planejar uma correção," "rode testes antes de abrir um PR," ou "poste resumo no Slack ao concluir uma tarefa." Mais de 100 embutidas ou escreva as suas. | | Gateway | Executa Claude Code, Codex, agentes de navegador e comandos de terminal na sua máquina ou em Docker e Railway, assim o CORE continua rodando com o laptop fechado. | | Agnóstico de modelo | Use seu próprio provedor: Anthropic, OpenAI ou modelos open-weight. Faça self-host do stack completo para isolamento total. |

Como o CORE se compara

| | CORE | OpenClaw | Hermes Agent | Devin / Copilot | |---|:---:|:---:|:---:|:---:| | Múltiplas interfaces (voz, bloco de notas, chat, mensagens) | ✅ | Parcial | ❌ | ❌ | | Memória persistente entre tarefas | ✅ | ❌ | ✅ | ❌ | | Delegação para agentes de código (Claude Code, Codex) | ✅ | ❌ | ❌ | ✅ | | Planejamento de tarefas estruturado com aprovação humana | ✅ | ❌ | ❌ | Parcial | | Nome, personalidade e voz personalizados | ✅ | ❌ | ❌ | ❌ | | Mais de 50 conectores de aplicativos | ✅ | Parcial | Parcial | ❌ | | Acesso ao terminal e navegador via gateway | ✅ | ✅ | ✅ | ✅ | | Humano no circuito por padrão | ✅ | ❌ | ❌ | ❌ | | Código aberto e auto-hospedável | ✅ | ✅ | ✅ | ❌ |

Guia Rápido

Código aberto e auto-hospedável. Seus dados permanecem na sua infraestrutura.

Escolha seu caminho:

| Eu quero... | Como | |---|---| | Testar na minha máquina | Execute a instalação em um passo abaixo (requer Docker) | | Implantar em um servidor ou VPS | Implantação com um clique via Railway | | Usar o aplicativo para Mac | Entre na lista de espera |

Instale e inicie o CORE:

npm install -g @redplanethq/corebrain && corebrain setupO assistente de configuração solicita um diretório de instalação, provedor de IA, chave de API e modelo de chat. Ele gera segredos, inicia a stack e abre http://localhost:3033.

A maioria das instalações locais leva alguns minutos após o Docker estar em execução.

Ou faça o deploy na Railway:

Conecte um gateway para que o CORE possa executar agentes de codificação, controlar seu navegador e acessar pastas locais:

corebrain login

corebrain gateway setupRequisitos: Docker 20.10+, Docker Compose 2.20+, 4 vCPU / 8GB RAM

Guia completo de auto-hospedagem

Sua primeira tarefa (2 minutos após a configuração):

- Abra o Scratchpad (sua página diária em

http://localhost:3033) - Digite

[ ] Resumir minhas issues abertas no GitHubou qualquer tarefa que normalmente faria - O CORE detecta em até 3 minutos, coleta contexto dos apps conectados e cria um plano

- Aprove o plano e o CORE executa, trazendo o resultado

Documentação

- Memória - Grafo temporal de conhecimento, classificação de fatos, recuperação orientada por intenção

- Scratchpad - Superfície diária onde tarefas e ideias começam

- Tarefas - Planos, estado, trabalho recorrente e contexto de tarefas

- Toolkit - Mais de 1000 ações em 50+ aplicativos via MCP

- Agente CORE - Gatilhos, memória, ferramentas e execução

- Gateway - WhatsApp, Slack, Telegram, e-mail, web e acesso via API

- Skills - Instruções reutilizáveis para fluxos de trabalho repetíveis

- Auto-hospedagem - Guia completo de implantação

- Changelog - O que foi lançado

Benchmark

O CORE alcança 88,24% de precisão média no benchmark LoCoMo em raciocínio single-hop, multi-hop, domínio aberto e temporal. Veja o repositório do benchmark para resultados completos e comparações de base.

Segurança

- Certificado CASA Nível 2

- TLS 1.3 em trânsito

- AES-256 em repouso

- Seus dados nunca são usados para treinamento de modelo

- Hospede localmente para isolamento total

- Política de segurança

- Vulnerabilidades: harshith@poozle.dev

Comunidade

Estamos construindo o CORE de forma pública.

Compartilhamos o roadmap e decisões arquiteturais abertamente porque os problemas mais difíceis de construir um sistema operacional pessoal são melhor resolvidos com as pessoas que o usam. Dê uma estrela no repositório, hospede você mesmo, compartilhe o que você constrói e abra issues para o que está quebrado ou faltando.

- Discord - perguntas, ideias, mostre e conte

- Docs de contribuição - como contribuir para o CORE

good-first-issue- comece por aqui

Hospede seu próprio sistema operacional de IA pessoal.

Dê uma estrela neste repositório · Leia a documentação · Entre no Discord

--- Tranlated By Open Ai Tx | Last indexed: 2026-05-20 ---