あなた専用のAI OS。

起動するチャットボットではありません。常に動作し、常に見守るAIです。 名前を付けて、形を決めて、あなたが使うすべてにつなげましょう。どんな働き方でもアクセス可能。 オープンソース、自分でホスト、永遠にあなたのもの。

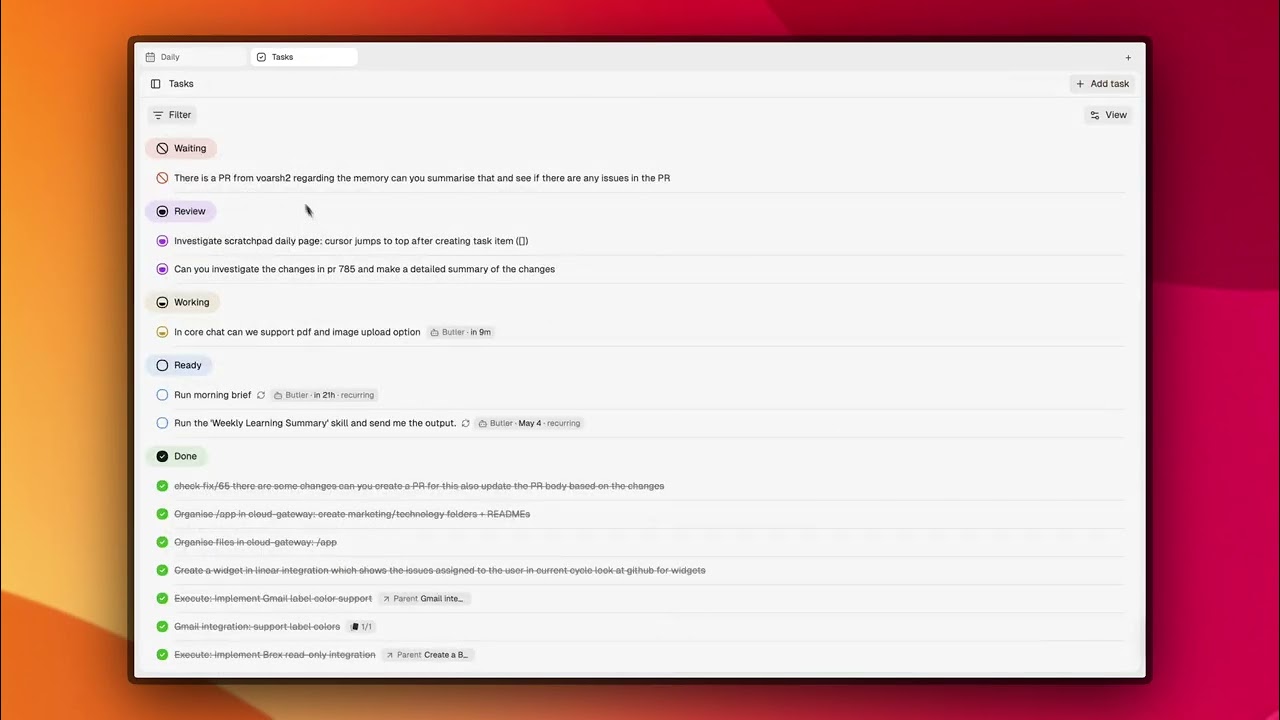

動作デモ

COREがプレーンテキストのタスクを受け取り、GitHubやメモリから文脈を収集し、作業を計画し、Claude Codeセッションを実行し、PRを作成する様子をご覧ください:

常に監視。常に準備万端。

ほとんどのAIツールは指示を待っています。COREは監視します。

アプリに接続すると、すべてのアプリのアクティビティを監視します。クライアントからメールが届く、GitHubのイシューが割り当てられる、Sentryのアラートが発生する、会議が終了する——COREはそれを検知し、メモリや設定されたスキルを確認して、自動で処理するか判断のために通知します。あなたがトリガーする必要はありません。CORE自身が気づきます。

Claude Code、Codex、またはCursorでCOREプラグインをインストールすると、エージェントとの会話も監視対象になります。議論されたコンテキスト、下された決定、書かれたコードなど、すべてがメモリナレッジグラフに記録されます。次のタスクをCOREが拾うときには、前回のセッションで何が起きたか既に把握しています。

COREが動作するときは、直接的に行動します。メールに返信したり、Linearのイシューを更新したり、GitHubでPRを作成したり、Slackメッセージを送信したり、ターミナルコマンドを実行したり、ブラウザを操作したり、任意のインターフェースからClaude CodeやCodexセッションを起動することができます。空港からWhatsAppメッセージを送れば、あなたが搭乗する前に、COREがコーディングセッションを開始しPRをオープンしてくれるでしょう。

どこで自動的に動作し、どこであなたの指示を待つかを決めてください。Sentryのアラートは自動で処理しますが、マージする前には必ず確認を求めます。コーディングセッションを始める前に計画を承認してください。メール送信前には必ず確認を要求します。自律のレベルは、タスクごと、アプリごと、アクションごとにあなたが設定できます。

4つのアクセス方法

チャットボットは1つのインターフェースしかありませんが、OSは多様です。

音声。 MacでCtrl+Optionを押して、やるべきことを話してください。COREはバックグラウンドで実行し、作業の流れを妨げません。

スクラッチパッド。 日々のページを開き、[ ] Fix the auth bug from issue #47と記入します。COREは3分以内に拾い上げ、リポジトリとメモリからコンテキストを取得し、計画案を作成します。

メッセージ。 WhatsApp、Slack、Telegram。空港からでも、スマートフォンからでも、ベッドの中からでもタスクを送信できます。COREは、どこからメッセージが来ても完全なコンテキストを把握しています。

チャット。 ダッシュボードを開き、直接会話できます。委任前にやりとりをしたい場合などに。

ひとつのAI、4つのインターフェース、すべてに共通する記憶とコンテキスト。

あなた仕様に

名前を付けましょう。話し方を選び、従うルールをどこにでも設定できます。

5種類の標準パーソナリティから選ぶことも、独自に作成することも可能です ― TARSのドライな効率性、Alfredの忠実なフォーマルさ、Hudsonの温かな実用性など。パーソナリティは、すべてのタスクや計画、あなたの代理で送信するメッセージに反映されます。

音声対話用の声を選択してください。その後は、すべてのインターフェースで設定したAIの声と振る舞いになります。

COREの実例

話して、PRに戻る。

Ctrl+Optionを押して話す: 「checkoutフローのレースコンディション(issue #312)を修正して。」

COREは課題を読み込み、関連コミットやSlackスレッドを取得し、計画案を作成し、Claude Codeセッションを実行します。戻ってくると、差分ができています。あなたはデスクにいる必要がありません。

夜に書いて、朝にレビュー。

スクラッチパッド: [ ] 今夜のバックログを11pmから処理開始

COREはLinear、GitHub、そして記憶から情報を取得し、優先順位を付けて、あなたが眠っている間に処理します。スムーズな進行はあなたのレビューを待っています。停滞したセッションは、停滞したタブではなく、1つの明確な質問として戻ってきます。

どこからでもメッセージを送信できます。

空港からWhatsApp: 「認証リファクタリングを出荷して。」

COREはすでにブランチ、文脈、あなたの好みを把握しています。Railway上で稼働しており、搭乗前にセッションを開始します。

アラートをインシデント化する前に調査します。

Sentryが2amに発火。 COREが調査し、関連トレースや過去のインシデントを記憶から取得し、修正案を提案、Slackで通知します: 「Issue #847、修正案提案済み、レビュー待ち。」あなたはスマホから承認します。

あなたの週を知っているブリーフを受け取る。

毎朝8amの定期タスク。 COREがメール、GitHub、Linear、Slackから情報を取得し、本当に注意が必要なものを浮かび上がらせ、必要ないものはスキップし、フォローアップを自動的にタスク化します。

COREの中身

| | | |---|---| | メモリ | あらゆるツールと会話を横断する時系列知識グラフ。好み、決定、目標、指示が記憶され、すべてのタスクが文脈付きで始まります。 | | タスク | 一度きりまたは定期的な作業単位。あなたの仕様、COREの計画、ライブ状態、専用チャットスレッド。各タスクはコーディング、ブラウザ、ターミナルセッションを派生可能。 | | コネクタ | 1つのMCPエンドポイントから50以上のアプリに接続、Webhookトリガーでプロアクティブな自動化。GitHub、Linear、Jira、Slack、Gmail、カレンダー、Sentry、Notion、Todoistなど。 | | スキル | 文脈に応じて自動発動する再利用可能な指示。例:「修正案を計画する前に関連Linearイシューを必ず取得」、「PRを開く前にテストを実行」、「タスク完了時にSlackにまとめを投稿」。100以上の組み込み、または独自作成可能。 | | ゲートウェイ | Claude Code、Codex、ブラウザエージェント、ターミナルコマンドをあなたのマシンやDocker、Railway上で実行。ノートPCを閉じてもCOREは動き続けます。 | | モデル非依存 | プロバイダーは選択可能:Anthropic、OpenAI、オープンウェイトモデル。フルスタックをセルフホストして完全隔離も可能。 |

COREの比較

| | CORE | OpenClaw | Hermes Agent | Devin / Copilot | |---|:---:|:---:|:---:|:---:| | 複数インターフェース(音声、スクラッチパッド、チャット、メッセージ) | ✅ | 部分 | ❌ | ❌ | | タスクを横断する永続メモリ | ✅ | ❌ | ✅ | ❌ | | コーディングエージェント(Claude Code, Codex)への委任 | ✅ | ❌ | ❌ | ✅ | | 人間の承認を伴う構造化タスク計画 | ✅ | ❌ | ❌ | 一部対応 | | カスタム名、個性、音声 | ✅ | ❌ | ❌ | ❌ | | 50以上のアプリコネクター | ✅ | 一部対応 | 一部対応 | ❌ | | ゲートウェイ経由のターミナルおよびブラウザーアクセス | ✅ | ✅ | ✅ | ✅ | | デフォルトでヒューマン・イン・ザ・ループ | ✅ | ❌ | ❌ | ❌ | | オープンソースおよびセルフホスト可能 | ✅ | ✅ | ✅ | ❌ |

クイックスタート

オープンソースかつセルフホスト型。あなたのデータは自分のインフラに保管されます。

あなたの進みたい道を選んでください:

| やりたいこと | 方法 | |---|---| | 自分のPCで試す | 下記のワンステップインストールを実行(Docker必須) | | サーバーやVPSにデプロイ | ワンクリックでRailwayにデプロイ | | Macアプリを使う | ウェイトリストに登録 |

COREのインストールと起動:

npm install -g @redplanethq/corebrain && corebrain setupセットアップウィザードは、インストールディレクトリ、AIプロバイダー、APIキー、およびチャットモデルを尋ねます。秘密情報を生成し、スタックを起動し、http://localhost:3033 を開きます。

Dockerが起動している場合、ほとんどのローカルインストールは数分で完了します。

または Railway でデプロイ:

ゲートウェイを接続して、COREがコーディングエージェントを実行し、ブラウザを操作し、ローカルフォルダーにアクセスできるようにします。

corebrain login

corebrain gateway setup要件: Docker 20.10以上、Docker Compose 2.20以上、4 vCPU / 8GB RAM

最初のタスク(セットアップ後2分):

- Scratchpad(日次ページ、

http://localhost:3033)を開く [ ] Summarize my open GitHub issuesまたは普段自分で行うタスクを入力する- COREが3分以内にタスクを取得し、接続アプリからコンテキストを収集し、計画案を作成

- 計画案を承認すると、COREが実行して結果を返す

ドキュメント

- Memory - 時間的知識グラフ、事実分類、意図駆動型検索

- Scratchpad - タスクやアイデアが始まる日次ページ

- Tasks - 計画、状態、定期作業、タスク固有のコンテキスト

- Toolkit - MCP経由で50以上のアプリで1000以上のアクション

- CORE Agent - トリガー、メモリ、ツール、実行

- Gateway - WhatsApp、Slack、Telegram、メール、Web、APIアクセス

- Skills - 繰り返し可能なワークフローのための再利用可能な指示

- セルフホスティング - 全展開ガイド

- Changelog - 出荷済み機能

ベンチマーク

COREはLoCoMoベンチマークで単一ホップ、マルチホップ、オープンドメイン、時間的推論全体で88.24%の平均精度を達成しています。詳細結果とベースライン比較はベンチマークリポジトリを参照してください。

セキュリティ

- CASA Tier 2 認証済み

- TLS 1.3 による通信

- AES-256による保存時の暗号化

- あなたのデータはモデル学習には一切使用されません

- 完全な隔離のためのセルフホスト

- セキュリティポリシー

- 脆弱性: harshith@poozle.dev

コミュニティ

私たちはCOREをオープンに開発しています。

ロードマップやアーキテクチャの決定を公開して共有するのは、パーソナルOSを作る上で最も難しい問題が、実際に使っている人々と一緒に解決できるからです。リポジトリにスターを付け、セルフホストし、作ったものを共有し、不具合や不足点はIssueで報告してください。

- Discord - 質問・アイデア・成果発表

- 貢献ドキュメント - COREへの貢献方法

good-first-issue- ここから始めましょう

あなたのパーソナルAI OSをセルフホストしましょう。

--- Tranlated By Open Ai Tx | Last indexed: 2026-05-20 ---