Il tuo sistema operativo AI personale.

Non un chatbot che apri. Un'IA sempre attiva, sempre vigile. Dagli un nome. Modellala. Collegala a tutto ciò che usi. Raggiungila in qualunque modo lavori. Open source, self-hosted, tua per sempre.

Guarda come funziona

Guarda CORE prendere un compito in testo semplice, raccogliere contesto da GitHub e dalla memoria, pianificare il lavoro, avviare una sessione Claude Code e aprire una PR:

Sempre vigile. Sempre pronto.

La maggior parte degli strumenti AI aspettano di essere richiesti. CORE osserva.

Collegalo alle tue app e monitora l’attività su tutte. Arriva una mail da un cliente, viene assegnato un issue su GitHub, scatta un alert su Sentry, termina una riunione. CORE lo vede, controlla la memoria e le competenze impostate, e lo gestisce oppure lo porta alla tua attenzione. Non lo attivi tu. Lo nota da solo.

Installa il plugin CORE su Claude Code, Codex o Cursor e anche le conversazioni degli agenti vengono monitorate. Il contesto discusso, le decisioni prese, il codice scritto: tutto alimenta il grafo della conoscenza di memoria. Il prossimo compito che CORE prenderà saprà già cosa è successo nella tua ultima sessione.

Quando agisce, lo fa direttamente. Può rispondere alle email, aggiornare i ticket su Linear, creare PR su GitHub, inviare messaggi Slack, eseguire comandi terminale, guidare un browser e avviare una sessione Claude Code o Codex da qualsiasi interfaccia. Manda un messaggio WhatsApp dall’aeroporto e CORE può avviare una sessione di coding e aprire una PR prima che tu salga a bordo.

Decidi tu dove agisce autonomamente e dove invece aspetta il tuo comando. Gestisci automaticamente gli alert Sentry ma chiedi sempre conferma prima di fare il merge. Approva un piano prima che inizi una sessione di coding. Richiedi conferma prima che venga inviata qualsiasi email. Il livello di autonomia lo imposti tu, per ogni compito, per ogni app, per ogni azione.

Quattro modi per interagire

Un chatbot ha un’unica interfaccia. Un sistema operativo ne ha molte.

Voce. Premi Ctrl+Option su Mac e pronuncia ciò che deve essere fatto. CORE esegue in background senza interrompere il tuo flusso.

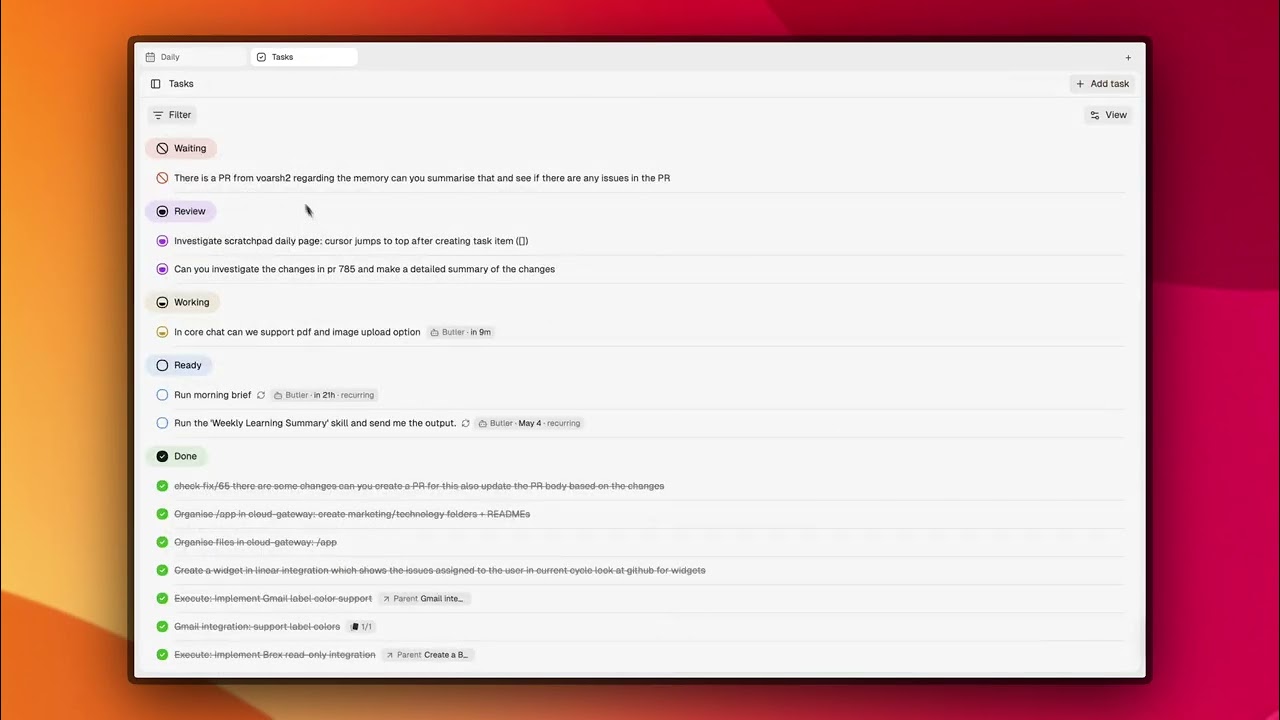

Scratchpad. Apri la tua pagina giornaliera e scrivi [ ] Risolvi il bug di autenticazione dall’issue #47. CORE lo rileva entro 3 minuti, carica il contesto dal tuo repo e dalla memoria, e redige un piano.

Messaggistica. WhatsApp, Slack, Telegram. Invia un compito dall’aeroporto, dal telefono, dal letto. CORE ha sempre il tuo contesto completo, indipendentemente da dove provenga il messaggio.

Chat. Apri la dashboard e parla direttamente, come con qualsiasi assistente. Quando vuoi un confronto prima di delegare.

Un’unica AI, quattro canali, stessa memoria e contesto su tutti.

Personalizzalo

Dagli un nome. Scegli come deve parlare. Imposta le regole che segue ovunque.

Scegli tra cinque personalità predefinite — l’efficienza asciutta di TARS, la formalità leale di Alfred, la praticità calorosa di Hudson — oppure crea la tua. La personalità si riflette in ogni attività svolta, in ogni piano redatto, in ogni messaggio inviato per tuo conto.

Scegli la sua voce per le interazioni parlate. Da quel momento, su ogni interfaccia, parlerà e si comporterà come l’AI che hai configurato.

CORE in azione

Dillo a voce, torna su una PR.

Premi Ctrl+Option, parla: "Risolvi la race condition nel checkout flow dall’issue #312."

CORE carica l’issue, recupera i commit correlati e le conversazioni Slack, redige un piano ed esegue una sessione Claude Code. Torni e trovi una diff. Non eri mai stato alla tua scrivania.

Scrivilo di notte, rivedilo al mattino.

Scratchpad: [ ] Lavora sull'arretrato di stasera a partire dalle 23:00

CORE si integra con Linear, GitHub e la memoria, dà priorità e lavora sulla coda mentre dormi. Le esecuzioni senza problemi ti aspettano per la revisione. Le sessioni bloccate tornano con una sola domanda mirata, non una scheda bloccata.

Mandagli un messaggio da ovunque.

WhatsApp dall’aeroporto: "Distribuisci il refactoring dell’autenticazione."

CORE già conosce il branch, il contesto e le tue preferenze. Sta girando su Railway. Avvia la sessione prima che tu salga a bordo.

Indaga sugli alert prima che diventino incidenti.

Sentry invia una notifica alle 2 di notte. CORE indaga, recupera tracce correlate e incidenti precedenti dalla memoria, propone una soluzione e ti contatta su Slack: "Issue #847, fix proposto, in attesa della tua revisione." Approvi dal telefono.

Ricevi un brief che conosce già la tua settimana.

Task ricorrente, ogni mattina alle 8. CORE recupera dati da email, GitHub, Linear e Slack, mostra solo ciò che richiede davvero attenzione, salta il resto e trasforma automaticamente i follow-up in task.

Cosa contiene CORE

| | | |---|---| | Memoria | Grafo temporale della conoscenza attraverso tutti gli strumenti e conversazioni. Preferenze, decisioni, obiettivi e direttive, così ogni task parte già con il contesto caricato. | | Task | Unità di lavoro singole o ricorrenti con la tua specifica, il piano di CORE, stato live e una chat dedicata. Ogni task può generare sessioni di coding, browser o terminale. | | Connettori | Oltre 50 app tramite un endpoint MCP, più trigger webhook per automazione proattiva. GitHub, Linear, Jira, Slack, Gmail, Calendar, Sentry, Notion, Todoist e altro ancora. | | Skill | Istruzioni riutilizzabili che si attivano automaticamente in base al contesto. Esempio: "recupera sempre le issue Linear correlate prima di pianificare una soluzione," "esegui i test prima di aprire una PR," o "posta un riassunto Slack quando un task si completa." Oltre 100 integrate, oppure scrivi le tue. | | Gateway | Esegue Claude Code, Codex, agenti browser e comandi terminale sulla tua macchina o in Docker e Railway, così CORE continua a lavorare anche a laptop chiuso. | | Indipendente dal modello | Scegli il tuo provider: Anthropic, OpenAI o modelli open-weight. Puoi ospitare tu tutto lo stack per isolamento totale. |

Come si confronta CORE

| | CORE | OpenClaw | Hermes Agent | Devin / Copilot | |---|:---:|:---:|:---:|:---:| | Interfacce multiple (voce, scratchpad, chat, messaggistica) | ✅ | Parziale | ❌ | ❌ | | Memoria persistente tra i task | ✅ | ❌ | ✅ | ❌ | | Delega ad agenti di coding (Claude Code, Codex) | ✅ | ❌ | ❌ | ✅ | | Pianificazione strutturata dei task con approvazione umana | ✅ | ❌ | ❌ | Parziale | | Nome personalizzato, personalità e voce | ✅ | ❌ | ❌ | ❌ | | Oltre 50 connettori per app | ✅ | Parziale | Parziale | ❌ | | Accesso a terminale e browser tramite gateway | ✅ | ✅ | ✅ | ✅ | | Human-in-loop di default | ✅ | ❌ | ❌ | ❌ | | Open source e self-hostable | ✅ | ✅ | ✅ | ❌ |

Avvio rapido

Open source e self-hosted. I tuoi dati rimangono nella tua infrastruttura.

Scegli il tuo percorso:

| Voglio... | Come | |---|---| | Provarlo sul mio computer | Esegui l'installazione in un solo passaggio qui sotto (richiede Docker) | | Distribuire su un server o VPS | Deploy con un clic su Railway | | Usare l'app per Mac | Unisciti alla lista d'attesa |

Installa e avvia CORE:

npm install -g @redplanethq/corebrain && corebrain setupLa procedura guidata di installazione richiede una directory di installazione, il provider AI, la chiave API e il modello di chat. Genera segreti, avvia lo stack e apre http://localhost:3033.

La maggior parte delle installazioni locali richiede alcuni minuti una volta che Docker è in esecuzione.

Oppure distribuisci su Railway:

Collega un gateway così CORE può eseguire agenti di codifica, controllare il tuo browser e accedere alle cartelle locali:

corebrain login

corebrain gateway setupRequisiti: Docker 20.10+, Docker Compose 2.20+, 4 vCPU / 8GB RAM

Guida completa all’auto-hosting

Il tuo primo compito (2 minuti dopo l’installazione):

- Apri il Scratchpad (la tua pagina giornaliera su

http://localhost:3033) - Digita

[ ] Riassumi le mie issue aperte su GitHubo qualsiasi attività che normalmente faresti tu stesso - CORE la rileva entro 3 minuti, raccoglie contesto dalle app connesse e redige un piano

- Approva il piano e CORE lo esegue e ti restituisce il risultato

Documentazione

- Memory - Grafo temporale della conoscenza, classificazione dei fatti, recupero guidato dall’intento

- Scratchpad - La superficie quotidiana dove iniziano compiti e idee

- Tasks - Piani, stato, lavoro ricorrente e contesto specifico dei compiti

- Toolkit - Oltre 1000 azioni su 50+ app tramite MCP

- CORE Agent - Trigger, memoria, strumenti ed esecuzione

- Gateway - Accesso via WhatsApp, Slack, Telegram, email, web e API

- Skills - Istruzioni riutilizzabili per flussi di lavoro ripetibili

- Self-hosting - Guida completa al deployment

- Changelog - Novità rilasciate

Benchmark

CORE raggiunge una precisione media dell’88,24% sul benchmark LoCoMo su ragionamento single-hop, multi-hop, open-domain e temporale. Consulta il repository del benchmark per risultati completi e confronti baseline.

Sicurezza

- Certificato CASA Livello 2

- TLS 1.3 in transito

- AES-256 a riposo

- I tuoi dati non vengono mai utilizzati per l’addestramento del modello

- Self-host per isolamento totale

- Politica di sicurezza

- Vulnerabilità: harshith@poozle.dev

Community

Stiamo costruendo CORE in modo pubblico.

Condividiamo la roadmap e le decisioni architetturali apertamente perché i problemi più difficili nella costruzione di un OS personale si risolvono meglio con le persone che lo usano. Metti una stella al repo, ospitalo tu stesso, condividi ciò che costruisci e apri issue per ciò che è rotto o manca.

- Discord - domande, idee, mostra e racconta

- Documenti per contribuire - come contribuire a CORE

good-first-issue- inizia qui

Self-host il tuo OS personale AI.

Metti una stella a questo repo · Leggi i documenti · Unisciti a Discord

--- Tranlated By Open Ai Tx | Last indexed: 2026-05-20 ---