Tu sistema operativo de IA personal.

No es un chatbot que abres. Es una IA que siempre está activa, siempre observando. Ponle un nombre. Moldea su forma. Conéctala a todo lo que usas. Accede a ella como tú trabajas. Código abierto, autohospedado, tuyo para siempre.

Velo en acción

Observa cómo CORE toma una tarea en texto plano, recopila contexto de GitHub y la memoria, planifica el trabajo, ejecuta una sesión de Claude Code y abre un PR:

Siempre observando. Siempre listo.

La mayoría de las herramientas de IA esperan a ser solicitadas. CORE observa.

Conéctalo a tus aplicaciones y monitorea la actividad en todas ellas. Llega un correo de un cliente, se asigna un issue de GitHub, se dispara una alerta de Sentry, termina una reunión. CORE lo detecta, revisa tu memoria y las habilidades configuradas, y lo maneja o lo presenta para tu decisión. No lo activas tú. Lo detecta por sí mismo.

Instala el plugin de CORE en Claude Code, Codex o Cursor y también se monitorean tus conversaciones con agentes. El contexto discutido, decisiones tomadas, código escrito, todo alimenta el grafo de conocimiento de memoria. La próxima tarea que CORE tome ya sabrá lo que ocurrió en tu última sesión.

Cuando actúa, lo hace de forma directa. Puede responder correos, actualizar issues de Linear, crear PRs de GitHub, enviar mensajes de Slack, ejecutar comandos en terminal, manejar un navegador y lanzar una sesión de Claude Code o Codex desde cualquier interfaz. Envía un mensaje por WhatsApp desde el aeropuerto y CORE puede tener una sesión de código corriendo y un PR abierto antes de que abordes.

Tú decides dónde actúa por sí solo y dónde espera a tu llamada. Maneja las alertas de Sentry automáticamente, pero siempre pregunta antes de hacer un merge. Aprueba un plan antes de que empiece una sesión de codificación. Exige confirmación antes de enviar cualquier correo electrónico. El nivel de autonomía lo defines tú, por tarea, por aplicación, por acción.

Cuatro formas de acceder

Un chatbot tiene una interfaz. Un sistema operativo tiene muchas.

Voz. Pulsa Ctrl+Opción en Mac y di lo que hay que hacer. CORE lo ejecuta en segundo plano sin interrumpir tu flujo.

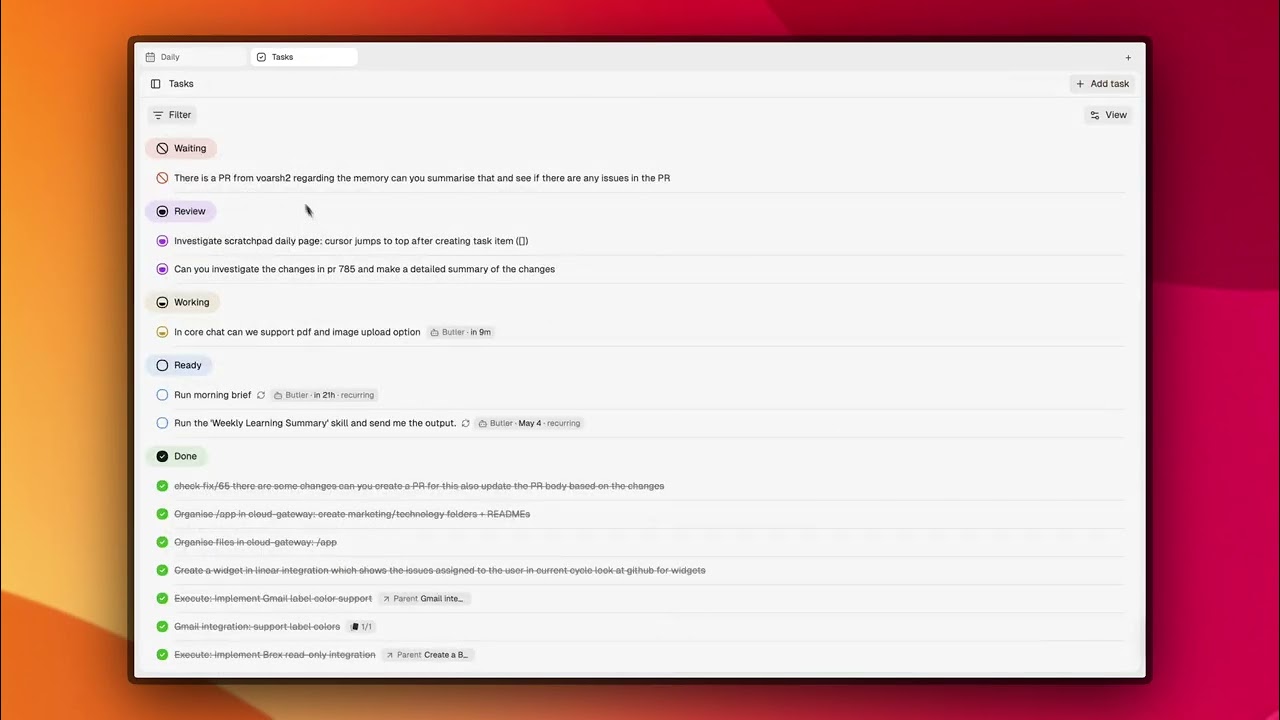

Cuaderno. Abre tu página diaria y escribe [ ] Arreglar el bug de autenticación del issue #47. CORE lo detecta en menos de 3 minutos, carga el contexto de tu repositorio y memoria, y redacta un plan.

Mensajería. WhatsApp, Slack, Telegram. Envía una tarea desde el aeropuerto, desde el móvil, desde la cama. CORE tiene todo tu contexto sin importar de dónde venga el mensaje.

Chat. Abre el panel de control y conversa directamente, como con cualquier asistente. Cuando quieres una ida y vuelta antes de delegar.

Una sola IA, cuatro superficies, la misma memoria y contexto detrás de todas ellas.

Hazlo tuyo

Ponle un nombre. Elige cómo habla. Configura las reglas que sigue en todas partes.

Elige entre cinco personalidades integradas — la eficiencia seca de TARS, la formalidad leal de Alfred, la practicidad cálida de Hudson — o crea la tuya propia. La personalidad se mantiene en cada tarea que ejecuta, cada plan que redacta, cada mensaje que envía en tu nombre.

Selecciona su voz para las interacciones habladas. Desde ese momento, suena y se comporta como la IA que configuraste, en todas las interfaces.

CORE en acción

Dilo, vuelve a un PR.

Pulsa Ctrl+Opción, di: "Arregla la condición de carrera en el flujo de checkout del issue #312."

CORE carga el issue, extrae los commits y hilos de Slack relacionados, redacta un plan y lanza una sesión de Claude Code. Vuelves y tienes un diff. Nunca estuviste en tu escritorio.

Escríbelo de noche, revísalo en la mañana.

Bloc de notas: [ ] Trabajar en el backlog de esta noche a partir de las 11pm

CORE extrae información de Linear, GitHub y memoria, prioriza y la procesa mientras duermes. Las sesiones fluidas esperan tu revisión. Las sesiones atascadas vuelven con una pregunta precisa, no una pestaña bloqueada.

Envíale mensajes desde cualquier lugar.

WhatsApp desde el aeropuerto: "Envía el refactor de autenticación."

CORE ya conoce la rama, el contexto y tus preferencias. Está ejecutándose en Railway. Inicia la sesión antes de que abordes.

Investiga alertas antes de que se conviertan en incidentes.

Sentry se activa a las 2am. CORE investiga, extrae trazas relacionadas e incidentes previos de la memoria, propone una solución y te avisa por Slack: "Issue #847, solución propuesta, esperando tu revisión." Apruebas desde tu teléfono.

Recibe un resumen que ya conoce tu semana.

Tarea recurrente, todas las mañanas a las 8am. CORE extrae información de email, GitHub, Linear y Slack, resalta lo que realmente requiere atención, omite lo que no, y convierte los seguimientos en tareas automáticamente.

Qué hay dentro de CORE

| | | |---|---| | Memoria | Grafo de conocimiento temporal en todas las herramientas y conversaciones. Preferencias, decisiones, metas y directivas, para que cada tarea inicie con el contexto cargado. | | Tareas | Unidades de trabajo puntuales o recurrentes con tu especificación, el plan de CORE, estado en vivo y un hilo de chat dedicado. Cada tarea puede generar sesiones de codificación, navegador o terminal. | | Conectores | Más de 50 aplicaciones a través de un único endpoint MCP, además de disparadores webhook para automatización proactiva. GitHub, Linear, Jira, Slack, Gmail, Calendario, Sentry, Notion, Todoist y más. | | Habilidades | Instrucciones reutilizables que se activan automáticamente según el contexto. Por ejemplo: "siempre extraer issues relacionados de Linear antes de planificar una solución," "ejecutar pruebas antes de abrir un PR," o "publicar un resumen en Slack cuando una tarea se complete." Más de 100 integradas, o escribe las tuyas. | | Gateway | Ejecuta Claude Code, Codex, agentes de navegador y comandos de terminal en tu máquina o en Docker y Railway, para que CORE siga trabajando cuando tu laptop esté cerrada. | | Agnóstico de modelos | Usa tu propio proveedor: Anthropic, OpenAI o modelos open-weight. Aloja toda la pila para aislamiento total. |

Cómo se compara CORE

| | CORE | OpenClaw | Hermes Agent | Devin / Copilot | |---|:---:|:---:|:---:|:---:| | Múltiples interfaces (voz, bloc de notas, chat, mensajería) | ✅ | Parcial | ❌ | ❌ | | Memoria persistente a través de tareas | ✅ | ❌ | ✅ | ❌ | | Delegación a agentes de codificación (Claude Code, Codex) | ✅ | ❌ | ❌ | ✅ | | Planificación de tareas estructuradas con aprobación humana | ✅ | ❌ | ❌ | Parcial | | Nombre, personalidad y voz personalizables | ✅ | ❌ | ❌ | ❌ | | Más de 50 conectores de aplicaciones | ✅ | Parcial | Parcial | ❌ | | Acceso a terminal y navegador vía gateway | ✅ | ✅ | ✅ | ✅ | | Humano en el bucle por defecto | ✅ | ❌ | ❌ | ❌ | | Código abierto y autoalojable | ✅ | ✅ | ✅ | ❌ |

Inicio rápido

Código abierto y autoalojado. Tus datos permanecen en tu infraestructura.

Elige tu camino:

| Quiero... | Cómo | |---|---| | Probarlo en mi máquina | Ejecuta la instalación en un paso a continuación (requiere Docker) | | Desplegar en un servidor o VPS | Despliegue con un clic en Railway | | Usar la app para Mac | Únete a la lista de espera |

Instala y comienza CORE:

npm install -g @redplanethq/corebrain && corebrain setupEl asistente de configuración solicita un directorio de instalación, proveedor de IA, clave API y modelo de chat. Genera secretos, inicia el stack y abre http://localhost:3033.

La mayoría de las instalaciones locales toman unos minutos una vez que Docker está en ejecución.

O implemente en Railway:

Conecte una pasarela para que CORE pueda ejecutar agentes de codificación, controlar su navegador y acceder a carpetas locales:

corebrain login

corebrain gateway setupRequisitos: Docker 20.10+, Docker Compose 2.20+, 4 vCPU / 8GB RAM

Guía completa de auto-hospedaje

Tu primera tarea (2 minutos después de la configuración):

- Abre el Scratchpad (tu página diaria en

http://localhost:3033) - Escribe

[ ] Resumir mis issues abiertos de GitHubo cualquier tarea que normalmente harías tú mismo - CORE la toma en menos de 3 minutos, recopila contexto de las apps conectadas y redacta un plan

- Aprueba el plan y CORE lo ejecuta y te trae el resultado

Documentos

- Memoria - Grafo de conocimiento temporal, clasificación de hechos, recuperación dirigida por intención

- Scratchpad - El espacio diario donde comienzan tareas e ideas

- Tareas - Planes, estado, trabajo recurrente y contexto por tarea

- Toolkit - Más de 1000 acciones en 50+ apps vía MCP

- Agente CORE - Disparadores, memoria, herramientas y ejecución

- Gateway - Acceso por WhatsApp, Slack, Telegram, email, web y API

- Skills - Instrucciones reutilizables para flujos de trabajo repetibles

- Auto-hospedaje - Guía completa de despliegue

- Changelog - Qué se ha lanzado

Benchmark

CORE alcanza un 88.24% de precisión promedio en el benchmark LoCoMo abarcando razonamiento de un solo paso, múltiple, dominio abierto y temporal. Consulta el repositorio del benchmark para resultados completos y comparaciones de referencia.

Seguridad

- Certificado CASA Nivel 2

- TLS 1.3 en tránsito

- AES-256 en reposo

- Tus datos nunca se usan para el entrenamiento del modelo

- Autoalojamiento para aislamiento total

- Política de seguridad

- Vulnerabilidades: harshith@poozle.dev

Comunidad

Estamos construyendo CORE en público.

Compartimos la hoja de ruta y las decisiones arquitectónicas abiertamente porque los problemas más difíciles al crear un sistema operativo personal se resuelven mejor con quienes lo usan. Dale estrella al repositorio, autoalójalo, comparte lo que construyas y abre issues para lo que esté roto o falte.

- Discord - preguntas, ideas, demos

- Documentos para contribuir - cómo contribuir a CORE

good-first-issue- empieza aquí

Aloja tu propio sistema operativo de IA personal.

Da estrella a este repo · Lee la documentación · Únete a Discord

--- Tranlated By Open Ai Tx | Last indexed: 2026-05-20 ---