ThinkSound

🌐 English | 简体中文 | 繁體中文 | Español | Français | 日本語

Nếu bạn thấy dự án này hữu ích,

hãy cho một sao ⭐ trên GitHub để động viên chúng tôi!

Sơ đồ thư mục của kho lưu trữ

Kho lưu trữ GitHub ThinkSound này chứa hai dự án liên quan trên các nhánh riêng biệt:

| Nhánh | Dự án | Tài liệu |

|-------|-------|----------|

| master | ThinkSound (NeurIPS 2025) — mô hình Any2Audio hợp nhất với flow matching được dẫn dắt bởi Chain-of-Thought (CoT) | File này: README.md |

| prismaudio | PrismAudio — công trình tiếp theo (ICLR 2026) về chuyển đổi video thành âm thanh với CoT-RL đa chiều | README.md trên nhánh prismaudio |

Đối với ThinkSound, hãy sử dụng nhánh master (README này). Đối với PrismAudio, hãy chuyển sang nhánh prismaudio và làm theo README.md tại đó.

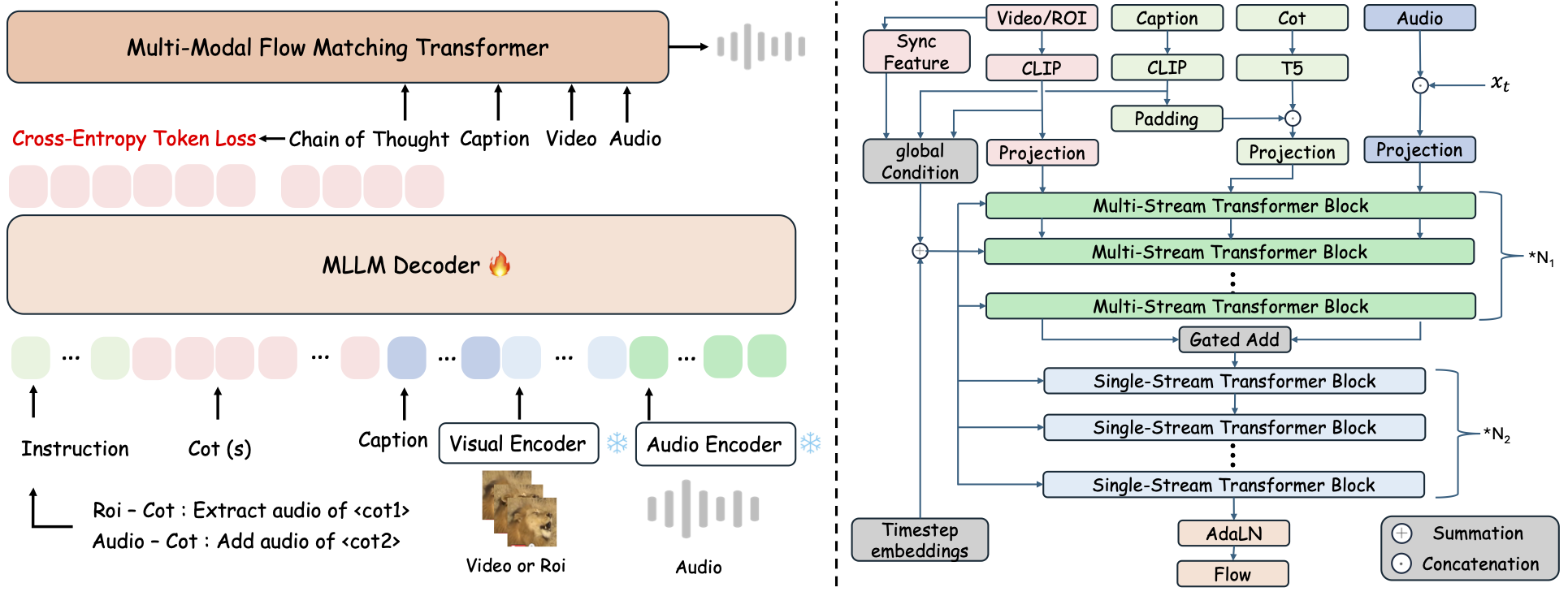

ThinkSound là khung hợp nhất Any2Audio với flow matching được dẫn dắt bởi Chain-of-Thought (CoT) reasoning.

Triển khai PyTorch cho tạo và chỉnh sửa âm thanh đa phương thức: tạo hoặc chỉnh sửa âm thanh từ video, văn bản và âm thanh, được hỗ trợ bởi suy luận từng bước từ MLLMs (Multimodal Large Language Models).

📰 Tin tức

- 2026.03.24 🔥 PrismAudio đã được phát hành trong cùng repo trên nhánh

prismaudio— xemREADME.mdtại đó để thiết lập và tải mô hình. - 2026.01.26 🎉 PrismAudio đã được nhận vào ICLR 2026 Main Conference (code/tài liệu trên

prismaudio). - 2025.11.25 🔥 Demo PrismAudio trực tuyến đã hoạt động.

- 2025.11.25 🔥 Bài báo PrismAudio trên arXiv — CoT-RL đa chiều cho chuyển đổi video thành âm thanh.

- 2025.09.19 🎉 ThinkSound đã được nhận vào NeurIPS 2025 Main Conference!

- 2025.09.01 Dataset AudioCoT của chúng tôi đã được mở nguồn và có trên Hugging Face!

- 2025.07.17 🧠 Đã bật finetuning: code huấn luyện và finetuning công khai, kèm hướng dẫn rõ ràng để bạn tùy chỉnh và mở rộng ThinkSound với dữ liệu riêng.

- 2025.07.15 📦 Cài đặt và sử dụng đơn giản: các dependency trên PyPI giúp thiết lập đa nền tảng dễ dàng; script

.batcho Windows tự động tạo môi trường và chạy script. - 2025.07.08 🔧 Cập nhật lớn: mô hình nhẹ hơn, tối ưu hóa bộ nhớ và GPU, hỗ trợ tạo âm thanh tốc độ cao quy mô lớn!

- 2025.07.01 Demo trực tuyến trên Hugging Face Spaces và ModelScope cho trải nghiệm tương tác!

- 2025.07.01 Phát hành script suy luận và giao diện web;

- 2025.06 Bài báo ThinkSound đã lên arXiv!

- 2025.06 Demo trực tuyến đã hoạt động - hãy thử ngay!

Công trình tiếp theo: PrismAudio (cùng repo, nhánh prismaudio)

PrismAudio là phiên bản kế thừa của ThinkSound (ICLR 2026), được phát triển dưới tên mới nhưng vẫn được giữ trong kho lưu trữ này trên nhánh prismaudio. Hướng dẫn cài đặt, checkpoint, và trích dẫn có trong README.md trên nhánh đó.👉 git checkout prismaudio hoặc mở nhánh đó trên GitHub.

🚀 Tính năng

- Any2Audio: Tạo âm thanh từ bất kỳ phương thức nào — video, văn bản, âm thanh, hoặc kết hợp chúng.

- Video-to-Audio SOTA: Đạt kết quả tiên tiến nhất trên nhiều bộ đánh giá V2A.

- Lập luận dựa trên CoT: Lập luận Chuỗi Suy Nghĩ cho tạo âm thanh có tính thành phần và kiểm soát thông qua MLLM.

- Chỉnh sửa tập trung vào đối tượng tương tác: Tinh chỉnh hoặc chỉnh sửa các sự kiện âm thanh cụ thể bằng cách nhấp vào đối tượng hình ảnh hoặc sử dụng hướng dẫn văn bản.

- Khung hợp nhất: Một mô hình nền tảng hỗ trợ tạo, chỉnh sửa và quy trình tương tác.

✨ Tổng quan phương pháp

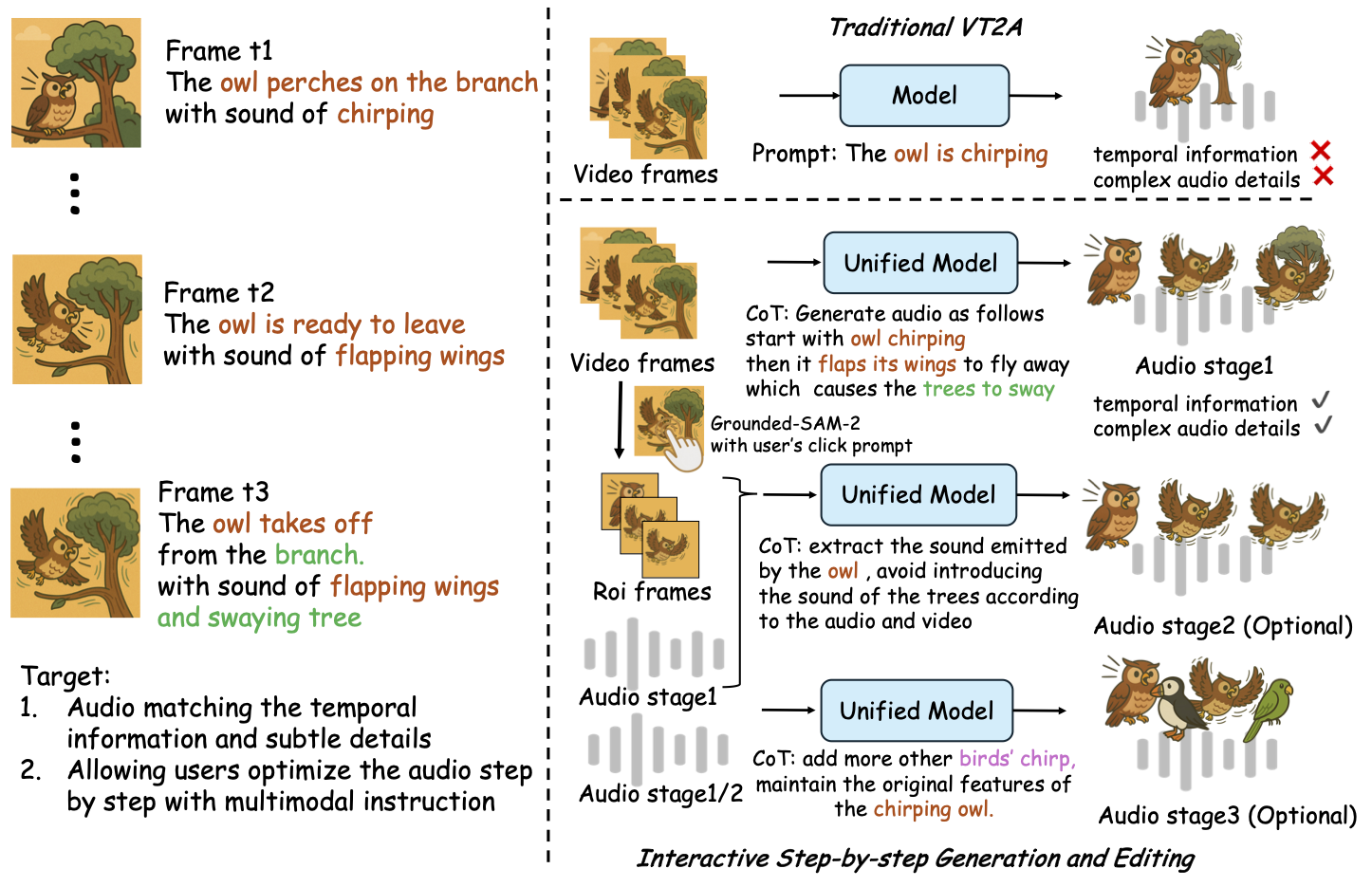

ThinkSound phân tách quá trình tạo và chỉnh sửa âm thanh thành ba giai đoạn tương tác, tất cả đều được hướng dẫn bởi lập luận Chuỗi Suy Nghĩ dựa trên MLLM (CoT):

- Tạo Foley: Sinh ra không gian âm thanh nền tảng, căn chỉnh ngữ nghĩa và thời gian từ video.

- Tinh chỉnh tập trung đối tượng: Tinh chỉnh hoặc thêm âm thanh cho các đối tượng do người dùng chỉ định thông qua nhấp chuột hoặc vùng trong video.

- Chỉnh sửa âm thanh có mục tiêu: Chỉnh sửa âm thanh được tạo bằng hướng dẫn ngôn ngữ tự nhiên cấp cao.

⚡ Bắt đầu nhanh

Chuẩn bị môi trường:

# ThinkSound code: branch master. PrismAudio: clone with -b prismaudio (see README.md on that branch).

git clone -b master https://github.com/liuhuadai/ThinkSound.git

cd ThinkSound

conda create -n thinksound python=3.10

conda activate thinksound

pip install thinksound

conda install -y -c conda-forge 'ffmpeg<7'

Download pretrained weights https://huggingface.co/liuhuadai/ThinkSound to Directory ckpts/

model weights can be also downloaded from https://www.modelscope.cn/models/iic/ThinkSound

git lfs install

git clone https://huggingface.co/liuhuadai/ThinkSound ckpts

To improve inference and training speed, you may optionally install a FlashAttention backend compatible with your system and PyTorch version.

✅ Mẹo cho Windows:

Người dùng Windows chỉ cần chạy setup_windows.bat (hoặc nhấp đúp vào nó) để tự động tạo môi trường conda, cài đặt tất cả các phụ thuộc (bao gồm cả FFmpeg), và tải về mô hình đã huấn luyện — không cần thiết lập thủ công.

Hãy đảm bảo rằngcondavàgitđã được cài đặt và có trong PATH hệ thống của bạn trước khi chạy script.

▶️ Chạy Demo

#### Linux/macOS

chmod +x scripts/demo.sh

./scripts/demo.sh <CoT description> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Bạn có thể sử dụng tập lệnh <code>.bat</code> được cung cấp thay thế:</p><pre><code class="language-bash">.\scripts\demo.bat <path-to-your-demo-video> <title> <CoT description> [use-half]</code></pre>

<strong>Lưu ý:</strong></p><ul><li><code><path-to-your-demo-video></code>: Đường dẫn đến một video duy nhất</li>

<li><code>[use-half]</code> (tùy chọn): Thêm use-half vào cuối để bật chức năng trích xuất đặc tả với độ chính xác nửa.</li></p><p></ul>---</p><h3>📦 Suy luận theo lô</h3></p><p>#### <strong>Linux/macOS</strong></p><pre><code class="language-bash">chmod +x scripts/eval_batch.sh

./scripts/eval_batch.sh <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Sử dụng script <code>.bat</code> tương đương:</p><pre><code class="language-bash">.\scripts\eval_batch.bat <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

<strong>Lưu ý:</strong></p><ul><li><code><video_path></code>: Đường dẫn đến thư mục gốc chứa tất cả các video .mp4 cần xử lý (tất cả video phải có cùng độ dài).</li>

<li><code><csv_path></code>: Một tệp CSV chứa các lệnh văn bản cho mỗi video (xem <code>demo_test.csv</code> để biết định dạng).</li>

<li><code><save_path></code> (tùy chọn): Nơi lưu trữ tệp âm thanh được tạo ra. Mặc định là <code>results/features</code>.</li>

<li><code>[use-half]</code> (tùy chọn): Thêm use-half ở cuối để bật tính năng trích xuất đặc trưng với độ chính xác nửa.</li></p><p></ul>---</p><h3>Sử Dụng Giao Diện Web</h3></p><p>Để trải nghiệm tương tác, hãy khởi chạy giao diện web Gradio:</p><pre><code class="language-bash">python app.py</code></pre>

<h2>🏋️ Huấn luyện Mô hình</h2></p><p>Xem <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/docs/Training.md" target="_blank" rel="noopener noreferrer"><code>Training.md</code></a></p><hr></p><h2>📄 Giấy phép</h2></p><p>Dự án này được phát hành dưới Giấy phép Apache 2.0.</p><blockquote><strong>Lưu ý:</strong></blockquote>

<blockquote>Mã nguồn, mô hình và tập dữ liệu chỉ <strong>dành cho mục đích nghiên cứu và giáo dục</strong>.</blockquote>

<blockquote><strong>Không được phép sử dụng cho mục đích thương mại.</strong></blockquote>

<blockquote>Để được cấp phép thương mại, vui lòng liên hệ với tác giả.</blockquote></p><p><strong>📦 Thành phần bên thứ ba</strong></p><ul><li><strong>Stable Audio Open VAE</strong> (bởi Stability AI):</li>

</ul>Kho lưu trữ này bao gồm một VAE được tinh chỉnh từ <a href="https://huggingface.co/stabilityai/stable-audio-open-1.0/" target="_blank" rel="noopener noreferrer">Stable Audio Open</a>, được cấp phép theo <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/./third_party/LICENSE_StabilityAI.md" target="_blank" rel="noopener noreferrer">Stability AI Community License</a>.

<strong>Việc sử dụng thương mại và phân phối lại yêu cầu sự cho phép trước từ Stability AI.</strong></p><ul><li>📘 <strong>Tất cả mã nguồn và mô hình còn lại</strong> được phát hành theo Giấy phép Apache 2.0.</li></p><p></ul>---</p><h2>Lời cảm ơn</h2></p><p>Xin chân thành cảm ơn:</p><ul><li><strong>stable-audio-tools</strong> (bởi Stability AI):</li>

</ul>Cảm ơn đã cung cấp một framework dễ sử dụng cho việc tạo âm thanh, cũng như module và trọng số VAE.

<ul><li><strong>MMAudio</strong>:</li>

</ul>Cho việc triển khai backbone MM-DiT trong lĩnh vực âm thanh.</p><hr></p><h2>📖 Trích dẫn</h2></p><p>Nếu bạn thấy dự án của chúng tôi hữu ích cho nghiên cứu hoặc công việc của mình, vui lòng trích dẫn bài báo của chúng tôi:</p><pre><code class="language-bibtex">@misc{liu2025thinksoundchainofthoughtreasoningmultimodal,

title={ThinkSound: Chain-of-Thought Reasoning in Multimodal Large Language Models for Audio Generation and Editing},

author={Huadai Liu and Jialei Wang and Kaicheng Luo and Wen Wang and Qian Chen and Zhou Zhao and Wei Xue},

year={2025},

eprint={2506.21448},

archivePrefix={arXiv},

primaryClass={eess.AS},

url={https://arxiv.org/abs/2506.21448},

}

@misc{liu2025prismaudiodecomposedchainofthoughtsmultidimensional,

title={PrismAudio: Decomposed Chain-of-Thoughts and Multi-dimensional Rewards for Video-to-Audio Generation},

author={Huadai Liu and Kaicheng Luo and Wen Wang and Qian Chen and Peiwen Sun and Rongjie Huang and Xiangang Li and Jieping Ye and Wei Xue},

year={2025},

eprint={2511.18833},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2511.18833},

}</code></pre></p><hr></p><h2>📬 Contact</h2></p><p>

✨ Feel free to <a href="https://github.com/liuhuadai/ThinkSound/issues" target="_blank" rel="noopener noreferrer">open an issue</a> or contact us via email (<a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/mailto:liuhuadai@zju.edu.cn" target="_blank" rel="noopener noreferrer">liuhuadai@zju.edu.cn</a>) if you have any questions or suggestions!</p><p>

---

Tranlated By <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">Open Ai Tx</a> | Last indexed: 2026-04-20

---</p>

</div>

<div class="original-link">

<strong>Original README:</strong> <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/README.md" target="_blank" rel="noopener noreferrer">View on GitHub</a>

</div>

</div>

<div class="footer">

<p>Translated by <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">OpenAiTx</a> |

Last updated: 2026-04-20

</div>

</body>

</html>