ThinkSound

🌐 English | 简体中文 | 繁體中文 | Español | Français | 日本語

Если вы считаете этот проект полезным,

звезда ⭐ на GitHub будет очень признательна!

Структура репозитория

В этом репозитории ThinkSound на GitHub размещены два связанных проекта на отдельных ветках:

| Ветка | Проект | Документация |

|--------|---------|----------------|

| master | ThinkSound (NeurIPS 2025) — унифицированная генерация Any2Audio с сопоставлением потоков, управляемым рассуждением CoT | Этот файл: README.md |

| prismaudio | PrismAudio — последующая работа (ICLR 2026) по преобразованию видео в аудио с многомерным CoT-RL | README.md на ветке prismaudio |

Для ThinkSound используйте ветку master (этот README). Для PrismAudio переключитесь на prismaudio и следуйте README.md там.

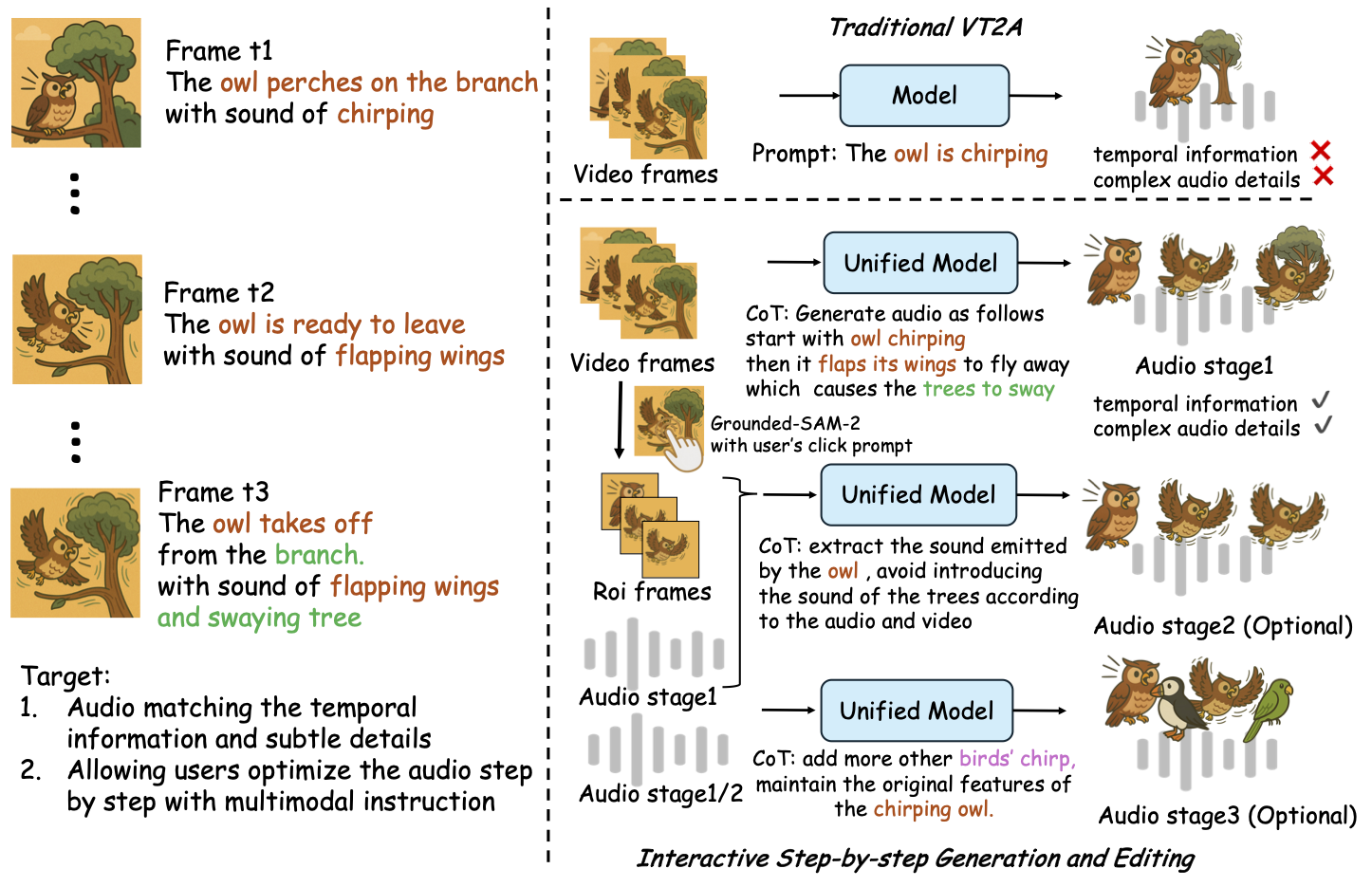

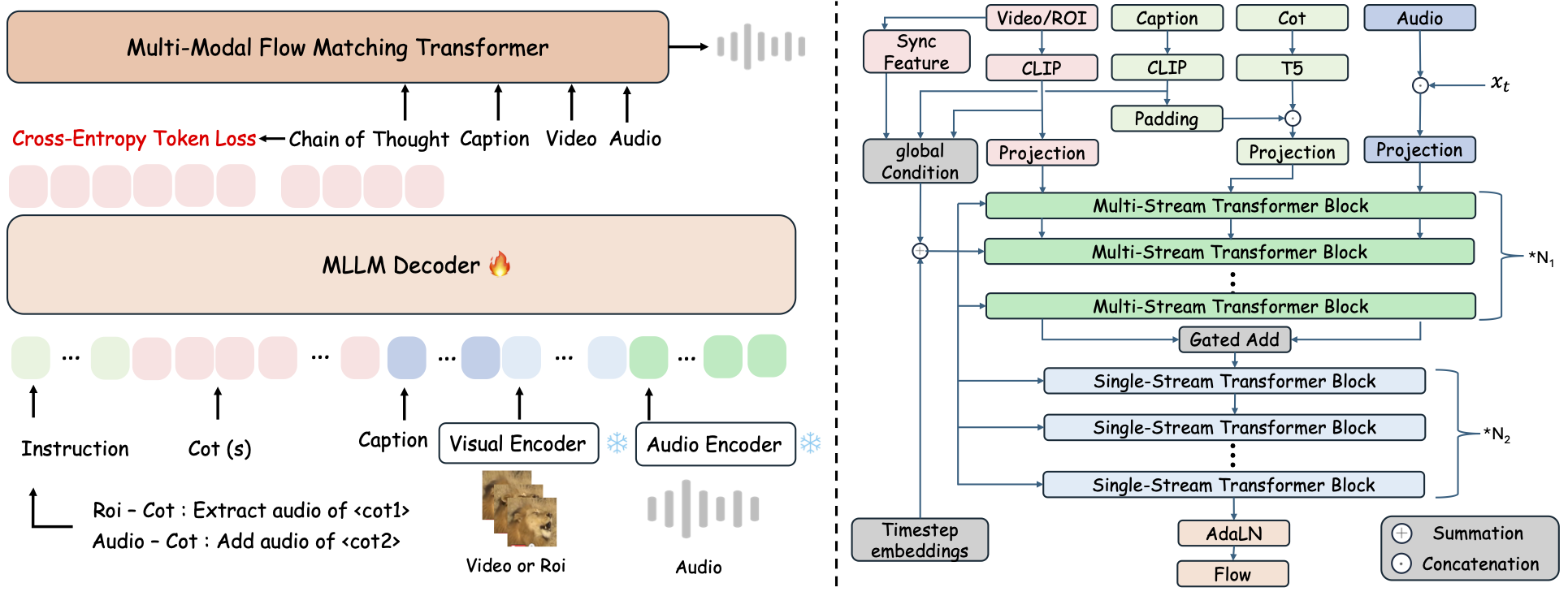

ThinkSound — это унифицированный фреймворк генерации Any2Audio с сопоставлением потоков, управляемым рассуждением Chain-of-Thought (CoT).

Реализация на PyTorch для мультимодальной генерации и редактирования аудио: генерируйте или редактируйте звук по видео, тексту и аудио, используя пошаговое рассуждение на базе мультимодальных больших языковых моделей (MLLMs).

📰 Новости

- 2026.03.24 🔥 PrismAudio выпущен в этом же репозитории на ветке

prismaudio— смотритеREADME.mdтам для установки и моделей. - 2026.01.26 🎉 PrismAudio принят на ICLR 2026 Main Conference (код/документация на

prismaudio). - 2025.11.25 🔥 Онлайн-демо PrismAudio запущено.

- 2025.11.25 🔥 Статья по PrismAudio на arXiv — многомерный CoT-RL для преобразования видео в аудио.

- 2025.09.19 🎉 ThinkSound принят на NeurIPS 2025 Main Conference!

- 2025.09.01 Наш датасет AudioCoT теперь с открытым исходным кодом и доступен на Hugging Face!

- 2025.07.17 🧠 Доступно дообучение: код для обучения и дообучения теперь в открытом доступе, с подробной инструкцией для быстрой настройки и расширения ThinkSound под ваши данные.

- 2025.07.15 📦 Упрощённая установка и использование: зависимости на PyPI для быстрой настройки на разных платформах; Windows

.bat-скрипты автоматизируют создание окружения и запуск сценариев. - 2025.07.08 🔧 Крупное обновление: модель облегчена и оптимизирована по памяти и использованию GPU, теперь поддерживает масштабную генерацию аудио!

- 2025.07.01 Онлайн-демо на Hugging Face Spaces и ModelScope для интерактивного опыта!

- 2025.07.01 Выпущены скрипты для инференса и веб-интерфейс;

- 2025.06 Статья по ThinkSound опубликована на arXiv!

- 2025.06 Онлайн-демо запущено — попробуйте прямо сейчас!

Продолжение: PrismAudio (тот же репозиторий, ветка prismaudio)

PrismAudio является преемником ThinkSound (ICLR 2026), разработан под новым названием, но хранится в этом репозитории в ветке prismaudio. Инструкции по установке, контрольные точки и цитирование находятся в файле README.md на этой ветке.

👉 git checkout prismaudio или откройте ветку на GitHub.

🚀 Возможности

- Any2Audio: Генерация аудио из любых модальностей — видео, текста, аудио или их комбинаций.

- Video-to-Audio SOTA: Достигает передовых результатов на нескольких V2A-бенчмарках.

- CoT-Driven Reasoning: Многошаговое рассуждение для композиционной и управляемой генерации аудио с помощью MLLM.

- Интерактивное объектно-ориентированное редактирование: Улучшение или редактирование конкретных звуковых событий по клику на визуальные объекты или с использованием текстовых инструкций.

- Единая структура: Одна базовая модель поддерживает генерацию, редактирование и интерактивный рабочий процесс.

✨ Обзор метода

ThinkSound разбивает генерацию и редактирование аудио на три интерактивные стадии, все они управляются многошаговым рассуждением (CoT) на базе MLLM:

- Генерация звукового фона: Создание базовых, семантически и временно согласованных звуковых пейзажей из видео.

- Объектно-ориентированное уточнение: Улучшение или добавление звуков для выбранных пользователем объектов через клики или выделение областей на видео.

- Целенаправленное аудио-редактирование: Изменение сгенерированного аудио с помощью высокоуровневых инструкций на естественном языке.

⚡ Быстрый старт

Подготовка среды:

# ThinkSound code: branch master. PrismAudio: clone with -b prismaudio (see README.md on that branch).

git clone -b master https://github.com/liuhuadai/ThinkSound.git

cd ThinkSound

conda create -n thinksound python=3.10

conda activate thinksound

pip install thinksound

conda install -y -c conda-forge 'ffmpeg<7'

Download pretrained weights https://huggingface.co/liuhuadai/ThinkSound to Directory ckpts/

model weights can be also downloaded from https://www.modelscope.cn/models/iic/ThinkSound

git lfs install

git clone https://huggingface.co/liuhuadai/ThinkSound ckpts

To improve inference and training speed, you may optionally install a FlashAttention backend compatible with your system and PyTorch version.

✅ Совет для Windows:

Пользователи Windows могут просто запустить setup_windows.bat (или дважды щелкнуть по нему), чтобы автоматически создать среду conda, установить все зависимости (включая FFmpeg) и загрузить предобученную модель — никакой ручной настройки не требуется.

Перед запуском скрипта убедитесь, чтоcondaиgitустановлены и доступны в переменной PATH вашей системы.

▶️ Запуск демо

#### Linux/macOS

chmod +x scripts/demo.sh

./scripts/demo.sh <CoT description> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Вместо этого вы можете использовать предоставленный скрипт <code>.bat</code>:</p><pre><code class="language-bash">.\scripts\demo.bat <path-to-your-demo-video> <title> <CoT description> [use-half]</code></pre>

<strong>Примечание:</strong></p><ul><li><code><path-to-your-demo-video></code>: Путь к одному видео</li>

<li><code>[use-half]</code> (необязательно): Добавьте use-half в конце для включения извлечения признаков в половинной точности.</li></p><p></ul>---</p><h3>📦 Пакетный вывод</h3></p><p>#### <strong>Linux/macOS</strong></p><pre><code class="language-bash">chmod +x scripts/eval_batch.sh

./scripts/eval_batch.sh <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Используйте эквивалентный скрипт <code>.bat</code>:</p><pre><code class="language-bash">.\scripts\eval_batch.bat <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

<strong>Примечание:</strong></p><ul><li><code><video_path></code>: Путь к корневому каталогу, содержащему все .mp4 видео для обработки (все видео должны быть одинаковой длительности).</li>

<li><code><csv_path></code>: CSV-файл с текстовыми подсказками для каждого видео (см. формат в <code>demo_test.csv</code>).</li>

<li><code><save_path></code> (необязательно): Путь для сохранения сгенерированного аудио. По умолчанию <code>results/features</code>.</li>

<li><code>[use-half]</code> (необязательно): Добавьте use-half в конце для включения извлечения признаков в половинной точности.</li></p><p></ul>---</p><h3>Использование веб-интерфейса</h3></p><p>Для интерактивной работы запустите веб-интерфейс Gradio:</p><pre><code class="language-bash">python app.py</code></pre>

<h2>🏋️ Обучение модели</h2></p><p>См. <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/docs/Training.md" target="_blank" rel="noopener noreferrer"><code>Training.md</code></a></p><hr></p><h2>📄 Лицензия</h2></p><p>Этот проект распространяется по лицензии Apache 2.0.</p><blockquote><strong>Примечание:</strong></blockquote>

<blockquote>Код, модели и датасет предназначены <strong>только для исследовательских и образовательных целей</strong>.</blockquote>

<blockquote><strong>Коммерческое использование НЕ разрешено.</strong></blockquote>

<blockquote>Для получения коммерческой лицензии свяжитесь с авторами.</blockquote></p><p><strong>📦 Сторонние компоненты</strong></p><ul><li><strong>Stable Audio Open VAE</strong> (от Stability AI):</li>

</ul>Этот репозиторий включает дообученный VAE из <a href="https://huggingface.co/stabilityai/stable-audio-open-1.0/" target="_blank" rel="noopener noreferrer">Stable Audio Open</a>, лицензированный по <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/./third_party/LICENSE_StabilityAI.md" target="_blank" rel="noopener noreferrer">Stability AI Community License</a>.

<strong>Коммерческое использование и распространение требуют предварительного разрешения от Stability AI.</strong></p><ul><li>📘 <strong>Весь остальной код и модели</strong> распространяются по лицензии Apache 2.0.</li></p><p></ul>---</p><h2>Благодарности</h2></p><p>Большое спасибо:</p><ul><li><strong>stable-audio-tools</strong> (от Stability AI):</li>

</ul>За предоставление удобного фреймворка для генерации аудио, а также за модуль VAE и веса.

<ul><li><strong>MMAudio</strong>:</li>

</ul>За реализацию MM-DiT-бэкенда в аудио-домене.</p><hr></p><h2>📖 Цитирование</h2></p><p>Если наш проект оказался полезен для ваших исследований или работы, пожалуйста, цитируйте нашу статью:</p><pre><code class="language-bibtex">@misc{liu2025thinksoundchainofthoughtreasoningmultimodal,

title={ThinkSound: Chain-of-Thought Reasoning in Multimodal Large Language Models for Audio Generation and Editing},

author={Huadai Liu and Jialei Wang and Kaicheng Luo and Wen Wang and Qian Chen and Zhou Zhao and Wei Xue},

year={2025},

eprint={2506.21448},

archivePrefix={arXiv},

primaryClass={eess.AS},

url={https://arxiv.org/abs/2506.21448},

}

@misc{liu2025prismaudiodecomposedchainofthoughtsmultidimensional,

title={PrismAudio: Decomposed Chain-of-Thoughts and Multi-dimensional Rewards for Video-to-Audio Generation},

author={Huadai Liu and Kaicheng Luo and Wen Wang and Qian Chen and Peiwen Sun and Rongjie Huang and Xiangang Li and Jieping Ye and Wei Xue},

year={2025},

eprint={2511.18833},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2511.18833},

}</code></pre></p><hr></p><h2>📬 Contact</h2></p><p>

✨ Feel free to <a href="https://github.com/liuhuadai/ThinkSound/issues" target="_blank" rel="noopener noreferrer">open an issue</a> or contact us via email (<a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/mailto:liuhuadai@zju.edu.cn" target="_blank" rel="noopener noreferrer">liuhuadai@zju.edu.cn</a>) if you have any questions or suggestions!</p><p>

---

Tranlated By <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">Open Ai Tx</a> | Last indexed: 2026-04-20

---</p>

</div>

<div class="original-link">

<strong>Original README:</strong> <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/README.md" target="_blank" rel="noopener noreferrer">View on GitHub</a>

</div>

</div>

<div class="footer">

<p>Translated by <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">OpenAiTx</a> |

Last updated: 2026-04-20

</div>

</body>

</html>