ThinkSound

🌐 English | 简体中文 | 繁體中文 | Español | Français | 日本語

Jeśli uważasz, że ten projekt jest przydatny,

będziemy bardzo wdzięczni za gwiazdkę ⭐ na GitHub!

Struktura repozytorium

To repozytorium ThinkSound na GitHubie zawiera dwa powiązane projekty na oddzielnych gałęziach:

| Gałąź | Projekt | Dokumentacja |

|--------|---------|----------------|

| master | ThinkSound (NeurIPS 2025) — zunifikowana generacja Any2Audio z dopasowaniem przepływu prowadzonym przez CoT | Ten plik: README.md |

| prismaudio | PrismAudio — praca kontynuacyjna (ICLR 2026) na temat video-to-audio z wielowymiarowym CoT-RL | README.md na gałęzi prismaudio |

Dla ThinkSound użyj gałęzi master (ten README). Dla PrismAudio przejdź na prismaudio i postępuj zgodnie z README.md tam.

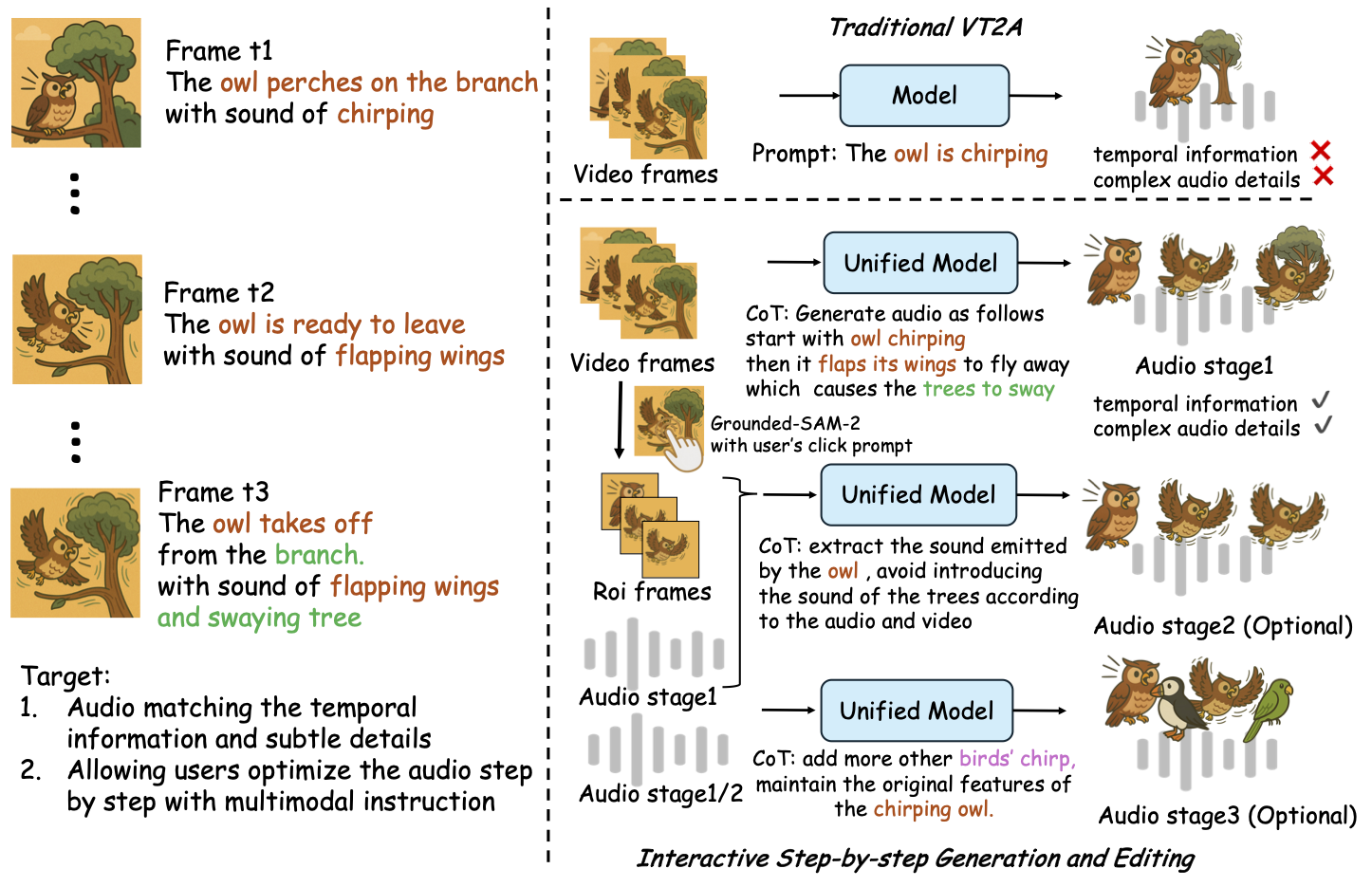

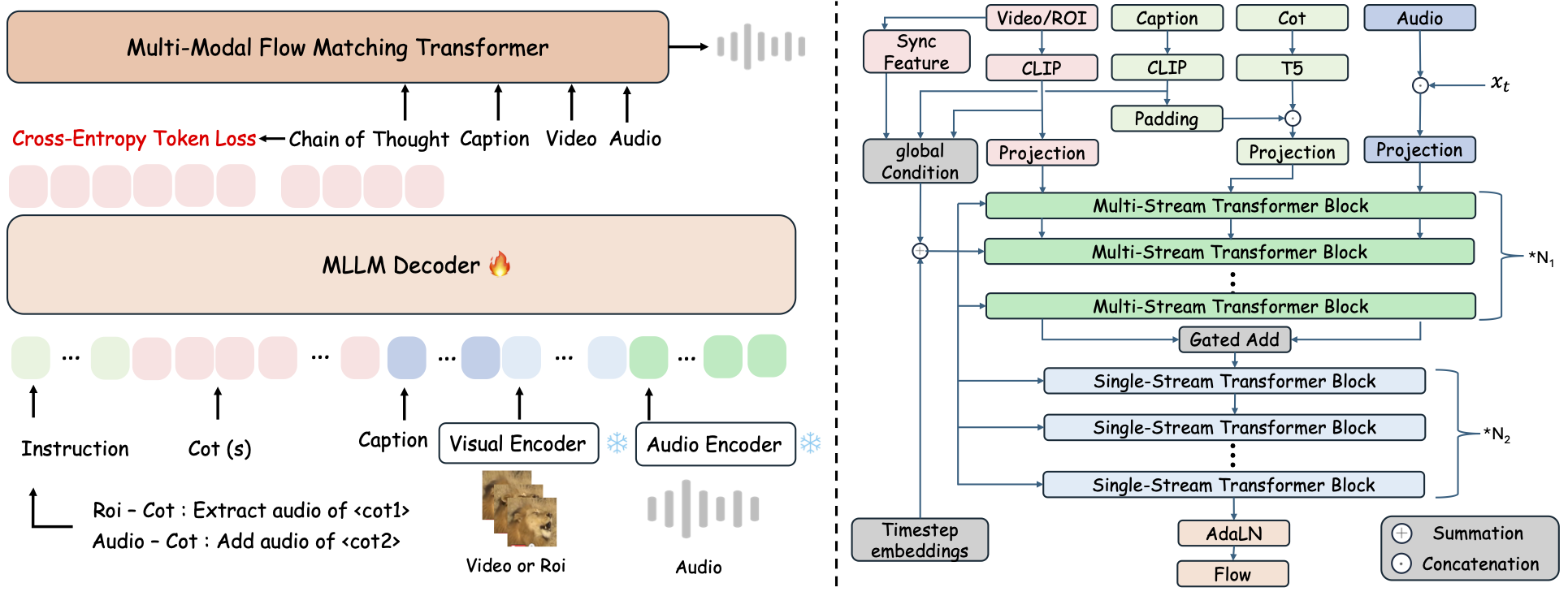

ThinkSound to zunifikowany framework generacji Any2Audio z dopasowaniem przepływu prowadzonym przez Chain-of-Thought (CoT).

Implementacja w PyTorch do multimodalnej generacji i edycji dźwięku: generuj lub edytuj audio z wideo, tekstu i audio, zasilana przez rozumowanie krok po kroku z Multimodalnymi Dużymi Modelami Językowymi (MLLM).

📰 Aktualności

- 2026.03.24 🔥 PrismAudio wydany w tym samym repozytorium na gałęzi

prismaudio— zobaczREADME.mdtam, aby uzyskać instrukcje i modele. - 2026.01.26 🎉 PrismAudio zaakceptowany na ICLR 2026 Main Conference (kod/dokumentacja na

prismaudio). - 2025.11.25 🔥 PrismAudio Demo Online jest dostępne.

- 2025.11.25 🔥 PrismAudio paper na arXiv — wielowymiarowy CoT-RL dla video-to-audio.

- 2025.09.19 🎉 ThinkSound zaakceptowany na NeurIPS 2025 Main Conference!

- 2025.09.01 Nasz zbiór danych AudioCoT jest już otwartoźródłowy i dostępny na Hugging Face!

- 2025.07.17 🧠 Finetuning włączony: kod do treningu i finetuningu jest już publiczny, z jasnymi instrukcjami użytkowania, które pozwalają dostosować i rozbudować ThinkSound o własne dane.

- 2025.07.15 📦 Uproszczona instalacja i użyteczność: zależności dostępne na PyPI dla łatwego, wieloplatformowego wdrożenia; skrypty Windows

.batautomatyzują tworzenie środowiska i uruchamianie skryptów. - 2025.07.08 🔧 Duża aktualizacja: model odchudzony i zoptymalizowano użycie pamięci oraz GPU, teraz obsługuje generację audio na dużą skalę!

- 2025.07.01 Demo online na Hugging Face Spaces oraz ModelScope dla interaktywnego doświadczenia!

- 2025.07.01 Wydano skrypty do inferencji i interfejs webowy;

- 2025.06 ThinkSound paper wydany na arXiv!

- 2025.06 Demo Online jest dostępne - wypróbuj teraz!

Kontynuacja: PrismAudio (to samo repozytorium, gałąź prismaudio)

PrismAudio jest następcą ThinkSound (ICLR 2026), rozwijanym pod nową nazwą, ale utrzymywanym w tym repozytorium na gałęzi prismaudio. Instrukcje instalacji, punkty kontrolne i cytowanie znajdują się w README.md na tej gałęzi.

👉 git checkout prismaudio lub otwórz gałąź na GitHubie.

🚀 Funkcje

- Any2Audio: Generowanie dźwięku z dowolnych modalności — wideo, tekstu, audio lub ich kombinacji.

- Video-to-Audio SOTA: Osiąga najlepsze wyniki na wielu benchmarkach V2A.

- CoT-Driven Reasoning: Chain-of-Thought reasoning do kompozycyjnego i kontrolowanego generowania dźwięku przez MLLM.

- Interaktywna Edycja Obiektowa: Poprawiaj lub edytuj określone zdarzenia dźwiękowe klikając na obiekty wizualne lub używając instrukcji tekstowych.

- Zunifikowany Framework: Jeden model bazowy obsługuje generowanie, edycję i interaktywny workflow.

✨ Przegląd Metody

ThinkSound rozbija generowanie i edycję dźwięku na trzy interaktywne etapy, wszystkie prowadzone przez Chain-of-Thought (CoT) oparty na MLLM:

- Generowanie Foley: Tworzenie podstawowych, semantycznie i czasowo dopasowanych pejzaży dźwiękowych z wideo.

- Doprecyzowanie obiektowe: Poprawianie lub dodawanie dźwięków dla wybranych przez użytkownika obiektów za pomocą kliknięć lub wskazanych obszarów na wideo.

- Celowana edycja audio: Modyfikacja wygenerowanego dźwięku za pomocą wysokopoziomowych instrukcji języka naturalnego.

⚡ Szybki Start

Przygotowanie środowiska:

# ThinkSound code: branch master. PrismAudio: clone with -b prismaudio (see README.md on that branch).

git clone -b master https://github.com/liuhuadai/ThinkSound.git

cd ThinkSound

conda create -n thinksound python=3.10

conda activate thinksound

pip install thinksound

conda install -y -c conda-forge 'ffmpeg<7'

Download pretrained weights https://huggingface.co/liuhuadai/ThinkSound to Directory ckpts/

model weights can be also downloaded from https://www.modelscope.cn/models/iic/ThinkSound

git lfs install

git clone https://huggingface.co/liuhuadai/ThinkSound ckpts

To improve inference and training speed, you may optionally install a FlashAttention backend compatible with your system and PyTorch version.

✅ Wskazówka dla Windows:

Użytkownicy Windows mogą po prostu uruchomić setup_windows.bat (lub kliknąć go dwukrotnie), aby automatycznie utworzyć środowisko conda, zainstalować wszystkie zależności (w tym FFmpeg) i pobrać wytrenowany model — bez konieczności ręcznej konfiguracji.

Przed uruchomieniem skryptu upewnij się, żecondaigitsą zainstalowane i dostępne w zmiennej PATH systemu.

▶️ Uruchom Demo

#### Linux/macOS

chmod +x scripts/demo.sh

./scripts/demo.sh <CoT description> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Możesz zamiast tego użyć dołączonego skryptu <code>.bat</code>:</p><pre><code class="language-bash">.\scripts\demo.bat <path-to-your-demo-video> <title> <CoT description> [use-half]</code></pre>

<strong>Uwaga:</strong></p><ul><li><code><ścieżka-do-twojego-wideo-demo></code>: Ścieżka do pojedynczego wideo</li>

<li><code>[use-half]</code> (opcjonalnie): Dodaj use-half na końcu, aby włączyć ekstrakcję cech w połowie precyzji.</li></p><p></ul>---</p><h3>📦 Przetwarzanie wsadowe</h3></p><p>#### <strong>Linux/macOS</strong></p><pre><code class="language-bash">chmod +x scripts/eval_batch.sh

./scripts/eval_batch.sh <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Użyj równoważnego skryptu <code>.bat</code>:</p><pre><code class="language-bash">.\scripts\eval_batch.bat <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

<strong>Uwaga:</strong></p><ul><li><code><video_path></code>: Ścieżka do katalogu głównego zawierającego wszystkie filmy .mp4 do przetworzenia (wszystkie filmy muszą mieć taką samą długość).</li>

<li><code><csv_path></code>: Plik CSV z tekstowymi podpowiedziami dla każdego filmu (zobacz <code>demo_test.csv</code> dla formatu).</li>

<li><code><save_path></code> (opcjonalnie): Gdzie zapisać wygenerowane audio. Domyślnie <code>results/features</code>.</li>

<li><code>[use-half]</code> (opcjonalnie): Dodaj use-half na końcu, aby włączyć ekstrakcję cech w trybie półprecyzyjnym.</li></p><p></ul>---</p><h3>Użycie interfejsu webowego</h3></p><p>Aby uzyskać interaktywne doświadczenie, uruchom interfejs webowy Gradio:</p><pre><code class="language-bash">python app.py</code></pre></p><h2>🏋️ Trening modelu</h2></p><p>Zobacz <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/docs/Training.md" target="_blank" rel="noopener noreferrer"><code>Training.md</code></a></p><hr></p><h2>📄 Licencja</h2></p><p>Ten projekt jest udostępniany na licencji Apache 2.0.</p><blockquote><strong>Uwaga:</strong></blockquote>

<blockquote>Kod, modele i zestaw danych są <strong>wyłącznie do celów badawczych i edukacyjnych</strong>.</blockquote>

<blockquote><strong>Użycie komercyjne NIE jest dozwolone.</strong></blockquote>

<blockquote>W sprawie licencjonowania komercyjnego prosimy o kontakt z autorami.</blockquote></p><p><strong>📦 Komponenty zewnętrzne</strong></p><ul><li><strong>Stable Audio Open VAE</strong> (autor: Stability AI):</li>

</ul>Repozytorium zawiera dostrojony VAE z <a href="https://huggingface.co/stabilityai/stable-audio-open-1.0/" target="_blank" rel="noopener noreferrer">Stable Audio Open</a>, licencjonowany na <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/./third_party/LICENSE_StabilityAI.md" target="_blank" rel="noopener noreferrer">Stability AI Community License</a>.

<strong>Użycie komercyjne i redystrybucja wymagają uprzedniej zgody Stability AI.</strong></p><ul><li>📘 <strong>Cały pozostały kod i modele</strong> są udostępnione na licencji Apache 2.0.</li></p><p></ul>---</p><h2>Podziękowania</h2></p><p>Serdeczne podziękowania dla:</p><ul><li><strong>stable-audio-tools</strong> (autor: Stability AI):</li>

</ul>Za udostępnienie łatwego w użyciu frameworka do generowania dźwięku, a także modułu VAE i wag.

<ul><li><strong>MMAudio</strong>:</li>

</ul>Za implementację szkieletu MM-DiT w domenie audio.</p><hr></p><h2>📖 Cytowanie</h2></p><p>Jeśli nasz projekt okazał się przydatny w Twoich badaniach lub pracy, prosimy o cytowanie naszej publikacji:</p><pre><code class="language-bibtex">@misc{liu2025thinksoundchainofthoughtreasoningmultimodal,

title={ThinkSound: Chain-of-Thought Reasoning in Multimodal Large Language Models for Audio Generation and Editing},

author={Huadai Liu and Jialei Wang and Kaicheng Luo and Wen Wang and Qian Chen and Zhou Zhao and Wei Xue},

year={2025},

eprint={2506.21448},

archivePrefix={arXiv},

primaryClass={eess.AS},

url={https://arxiv.org/abs/2506.21448},

}

@misc{liu2025prismaudiodecomposedchainofthoughtsmultidimensional,

title={PrismAudio: Decomposed Chain-of-Thoughts and Multi-dimensional Rewards for Video-to-Audio Generation},

author={Huadai Liu and Kaicheng Luo and Wen Wang and Qian Chen and Peiwen Sun and Rongjie Huang and Xiangang Li and Jieping Ye and Wei Xue},

year={2025},

eprint={2511.18833},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2511.18833},

}</code></pre></p><hr></p><h2>📬 Contact</h2></p><p>

✨ Feel free to <a href="https://github.com/liuhuadai/ThinkSound/issues" target="_blank" rel="noopener noreferrer">open an issue</a> or contact us via email (<a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/mailto:liuhuadai@zju.edu.cn" target="_blank" rel="noopener noreferrer">liuhuadai@zju.edu.cn</a>) if you have any questions or suggestions!</p><p>

---

Tranlated By <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">Open Ai Tx</a> | Last indexed: 2026-04-20

---</p>

</div>

<div class="original-link">

<strong>Original README:</strong> <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/README.md" target="_blank" rel="noopener noreferrer">View on GitHub</a>

</div>

</div>

<div class="footer">

<p>Translated by <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">OpenAiTx</a> |

Last updated: 2026-04-20

</div>

</body>

</html>