ThinkSound

🌐 Engels | 简体中文 | 繁體中文 | Spaans | Frans | Japans

Als je dit project nuttig vindt,

zouden we een ster ⭐ op GitHub erg waarderen!

Indeling van de repository

Deze ThinkSound GitHub-repository bevat twee gerelateerde projecten op afzonderlijke branches:

| Branch | Project | Documentatie |

|--------|---------|----------------|

| master | ThinkSound (NeurIPS 2025) — uniforme Any2Audio-generatie met CoT-gestuurde flow matching | Dit bestand: README.md |

| prismaudio | PrismAudio — vervolgwerk (ICLR 2026) aan video-naar-audio met multi-dimensionale CoT-RL | README.md op de prismaudio branch |

Voor ThinkSound gebruik je de branch master (deze README). Voor PrismAudio ga naar prismaudio en volg daar de README.md.

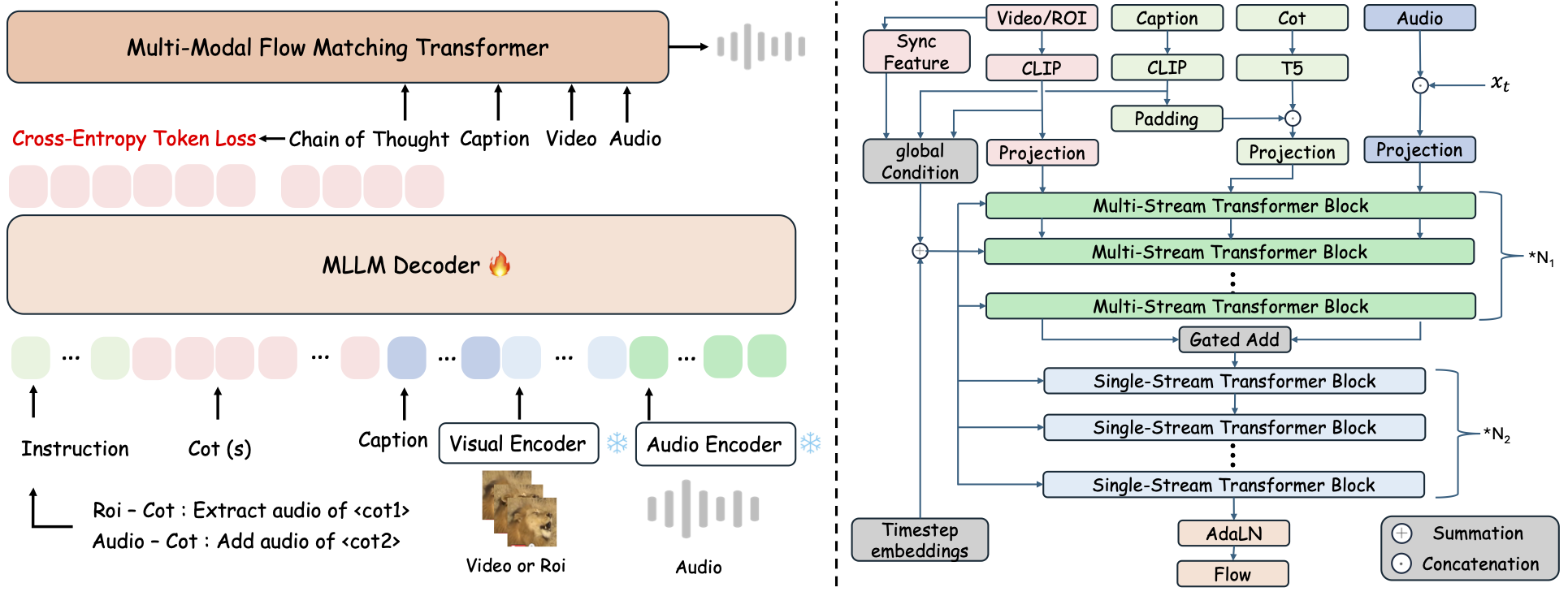

ThinkSound is een uniform Any2Audio-generatieframework met flow matching, geleid door Chain-of-Thought (CoT)-redenering.

PyTorch-implementatie voor multimodale audiogeneratie en -bewerking: genereer of bewerk audio uit video, tekst en audio, aangedreven door stapsgewijze redenering van Multimodal Large Language Models (MLLM's).

📰 Nieuws

- 2026.03.24 🔥 PrismAudio is uitgebracht in dezelfde repo op branch

prismaudio— zie daarREADME.mdvoor installatie en modellen. - 2026.01.26 🎉 PrismAudio geaccepteerd voor ICLR 2026 Main Conference (code/docs op

prismaudio). - 2025.11.25 🔥 Online PrismAudio Demo is live.

- 2025.11.25 🔥 PrismAudio paper op arXiv — multi-dimensionale CoT-RL voor video-naar-audio.

- 2025.09.19 🎉 ThinkSound geaccepteerd voor de NeurIPS 2025 Main Conference!

- 2025.09.01 Onze AudioCoT-dataset is nu open source en beschikbaar op Hugging Face!

- 2025.07.17 🧠 Finetuning ingeschakeld: trainings- en finetuningcode nu publiek beschikbaar, met duidelijke gebruiksinstructies om ThinkSound met je eigen data aan te passen en uit te breiden.

- 2025.07.15 📦 Eenvoudige installatie en bruikbaarheid: afhankelijkheden via PyPI voor eenvoudige cross-platform setup; Windows

.bat-scripts automatiseren het aanmaken van de omgeving en het uitvoeren van scripts. - 2025.07.08 🔧 Grote update: model geoptimaliseerd voor lichtgewicht en verbeterd geheugen- en GPU-gebruik, ondersteunt nu grootschalige en snelle audiogeneratie!

- 2025.07.01 Online demo op Hugging Face Spaces en ModelScope voor interactieve ervaring!

- 2025.07.01 Inferencescripts en webinterface uitgebracht;

- 2025.06 ThinkSound paper uitgebracht op arXiv!

- 2025.06 Online Demo is live - probeer het nu!

Vervolg: PrismAudio (zelfde repo, prismaudio branch)

PrismAudio is de opvolger van ThinkSound (ICLR 2026), ontwikkeld onder een nieuwe naam maar bewaard in deze repository op de branch prismaudio. Installatie, checkpoints en citatie zijn te vinden in README.md op die branch.

👉 git checkout prismaudio of open de branch op GitHub.

🚀 Functies

- Any2Audio: Genereer audio vanuit willekeurige modaliteiten — video, tekst, audio of hun combinaties.

- Video-naar-Audio SOTA: Behaalt state-of-the-art resultaten op meerdere V2A benchmarks.

- CoT-Gedreven Redeneren: Chain-of-Thought redeneren voor compositie en controleerbare audiogeneratie via MLLMs.

- Interactieve Objectgerichte Bewerking: Verfijn of bewerk specifieke geluidsgebeurtenissen door op visuele objecten te klikken of tekstinstructies te gebruiken.

- Uniform Framework: Eén foundation model ondersteunt generatie, bewerking en interactieve workflow.

✨ Methode Overzicht

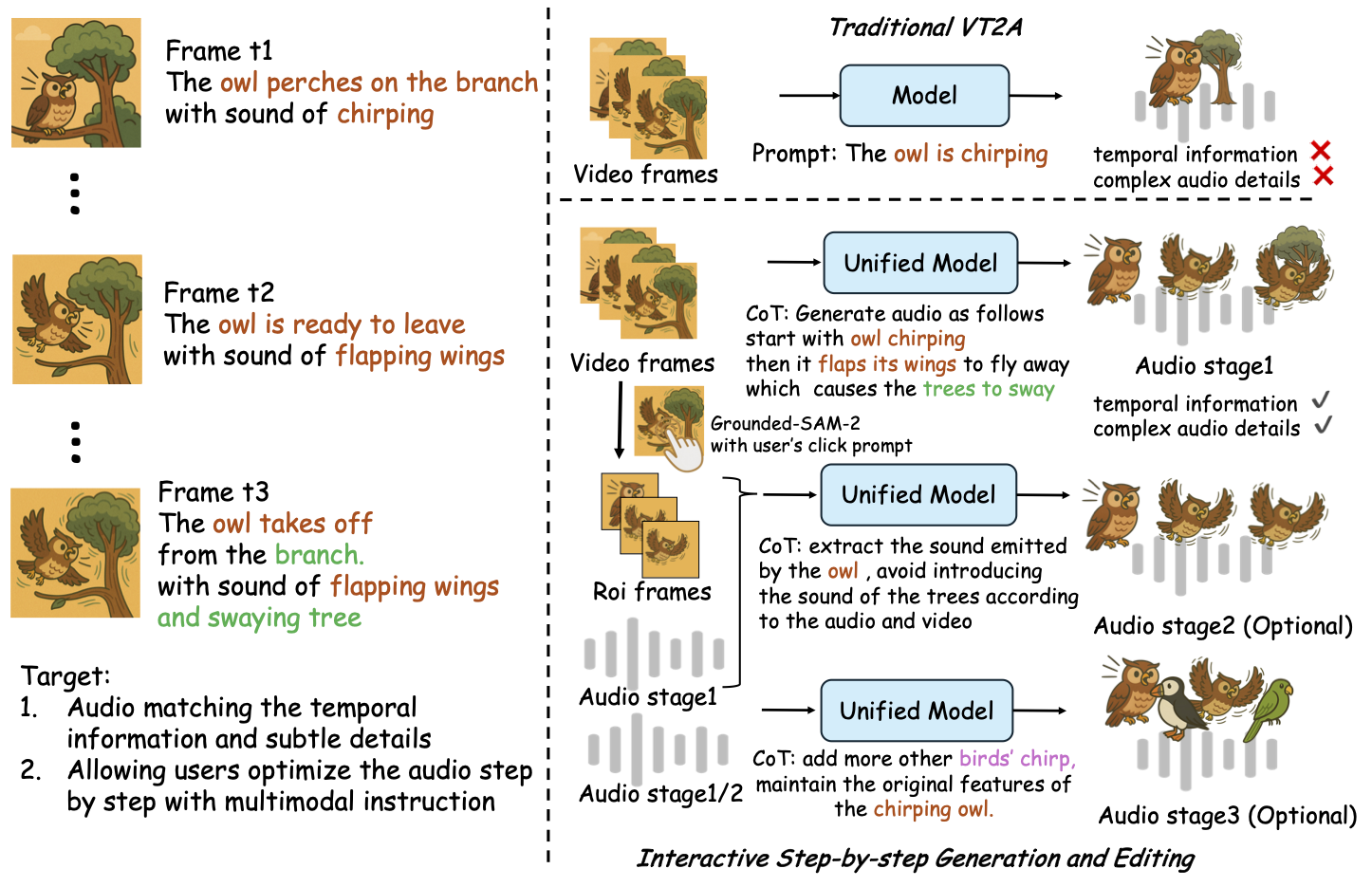

ThinkSound splitst audiogeneratie en -bewerking op in drie interactieve fasen, allen aangestuurd door MLLM-gebaseerd Chain-of-Thought (CoT) redeneren:

- Foley Generatie: Genereer fundamentele, semantisch en temporeel uitgelijnde soundscapes vanuit video.

- Objectgerichte Verfijning: Verfijn of voeg geluiden toe aan door de gebruiker gespecificeerde objecten via klikken of regio's in de video.

- Gerichte Audio Bewerking: Bewerk gegenereerde audio met behulp van natuurlijke taal instructies op hoog niveau.

⚡ Snelstart

Omgevingsvoorbereiding:

# ThinkSound code: branch master. PrismAudio: clone with -b prismaudio (see README.md on that branch).

git clone -b master https://github.com/liuhuadai/ThinkSound.git

cd ThinkSound

conda create -n thinksound python=3.10

conda activate thinksound

pip install thinksound

conda install -y -c conda-forge 'ffmpeg<7'

Download pretrained weights https://huggingface.co/liuhuadai/ThinkSound to Directory ckpts/

model weights can be also downloaded from https://www.modelscope.cn/models/iic/ThinkSound

git lfs install

git clone https://huggingface.co/liuhuadai/ThinkSound ckpts

To improve inference and training speed, you may optionally install a FlashAttention backend compatible with your system and PyTorch version.

✅ Windows Tip:

Windows-gebruikers kunnen eenvoudig setup_windows.bat uitvoeren (of dubbelklikken) om automatisch de conda-omgeving aan te maken, alle afhankelijkheden te installeren (inclusief FFmpeg) en het voorgetrainde model te downloaden — geen handmatige installatie vereist.

Zorg ervoor datcondaengitzijn geïnstalleerd en beschikbaar zijn in je systeem-PATH voordat je het script uitvoert.

▶️ Demo uitvoeren

#### Linux/macOS

chmod +x scripts/demo.sh

./scripts/demo.sh <CoT description> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>U kunt in plaats daarvan het meegeleverde <code>.bat</code>-script gebruiken:</p><pre><code class="language-bash">.\scripts\demo.bat <path-to-your-demo-video> <title> <CoT description> [use-half]</code></pre>

<strong>Opmerking:</strong></p><ul><li><code><pad-naar-je-demo-video></code>: Het pad naar een enkele video</li>

<li><code>[use-half]</code> (optioneel): Voeg use-half toe aan het einde om halfprecisie feature-extractie in te schakelen.</li></p><p></ul>---</p><h3>📦 Batch-inferentie</h3></p><p>#### <strong>Linux/macOS</strong></p><pre><code class="language-bash">chmod +x scripts/eval_batch.sh

./scripts/eval_batch.sh <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Gebruik het equivalente <code>.bat</code>-script:</p><pre><code class="language-bash">.\scripts\eval_batch.bat <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

<strong>Opmerking:</strong></p><ul><li><code><video_path></code>: Pad naar de hoofdmap met alle .mp4-video’s die verwerkt moeten worden (alle video’s moeten even lang zijn).</li>

<li><code><csv_path></code>: Een CSV-bestand met tekstprompts voor elke video (zie <code>demo_test.csv</code> voor het formaat).</li>

<li><code><save_path></code> (optioneel): Locatie om gegenereerde audio op te slaan. Standaard <code>results/features</code>.</li>

<li><code>[use-half]</code> (optioneel): Voeg use-half toe aan het einde om extractie met halve precisie in te schakelen.</li></p><p></ul>---</p><h3>Gebruik van de webinterface</h3></p><p>Voor een interactieve ervaring start je de Gradio webinterface:</p><pre><code class="language-bash">python app.py</code></pre>

<h2>🏋️ Train het model</h2></p><p>Zie <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/docs/Training.md" target="_blank" rel="noopener noreferrer"><code>Training.md</code></a></p><hr></p><h2>📄 Licentie</h2></p><p>Dit project is uitgebracht onder de Apache 2.0 Licentie.</p><blockquote><strong>Opmerking:</strong></blockquote>

<blockquote>De code, modellen en dataset zijn <strong>alleen voor onderzoeks- en educatieve doeleinden</strong>.</blockquote>

<blockquote><strong>Commercieel gebruik is NIET toegestaan.</strong></blockquote>

<blockquote>Voor commerciële licenties, neem contact op met de auteurs.</blockquote></p><p><strong>📦 Componenten van derden</strong></p><ul><li><strong>Stable Audio Open VAE</strong> (door Stability AI):</li>

</ul>Deze repository bevat een fijn-afgestelde VAE van <a href="https://huggingface.co/stabilityai/stable-audio-open-1.0/" target="_blank" rel="noopener noreferrer">Stable Audio Open</a>, gelicentieerd onder de <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/./third_party/LICENSE_StabilityAI.md" target="_blank" rel="noopener noreferrer">Stability AI Community License</a>.

<strong>Commercieel gebruik en distributie vereisen vooraf toestemming van Stability AI.</strong></p><ul><li>📘 <strong>Alle overige code en modellen</strong> zijn uitgebracht onder de Apache License 2.0.</li></p><p></ul>---</p><h2>Dankbetuigingen</h2></p><p>Veel dank aan:</p><ul><li><strong>stable-audio-tools</strong> (door Stability AI):</li>

</ul>Voor het bieden van een gebruiksvriendelijk framework voor audiogeneratie, evenals de VAE-module en gewichten.

<ul><li><strong>MMAudio</strong>:</li>

</ul>Voor de implementatie van de MM-DiT backbone in het audiodomein.</p><hr></p><h2>📖 Referentie</h2></p><p>Als u ons project nuttig vindt voor uw onderzoek of werk, citeer dan ons artikel:</p><pre><code class="language-bibtex">@misc{liu2025thinksoundchainofthoughtreasoningmultimodal,

title={ThinkSound: Chain-of-Thought Reasoning in Multimodal Large Language Models for Audio Generation and Editing},

author={Huadai Liu and Jialei Wang and Kaicheng Luo and Wen Wang and Qian Chen and Zhou Zhao and Wei Xue},

year={2025},

eprint={2506.21448},

archivePrefix={arXiv},

primaryClass={eess.AS},

url={https://arxiv.org/abs/2506.21448},

}

@misc{liu2025prismaudiodecomposedchainofthoughtsmultidimensional,

title={PrismAudio: Decomposed Chain-of-Thoughts and Multi-dimensional Rewards for Video-to-Audio Generation},

author={Huadai Liu and Kaicheng Luo and Wen Wang and Qian Chen and Peiwen Sun and Rongjie Huang and Xiangang Li and Jieping Ye and Wei Xue},

year={2025},

eprint={2511.18833},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2511.18833},

}</code></pre></p><hr></p><h2>📬 Contact</h2></p><p>

✨ Feel free to <a href="https://github.com/liuhuadai/ThinkSound/issues" target="_blank" rel="noopener noreferrer">open an issue</a> or contact us via email (<a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/mailto:liuhuadai@zju.edu.cn" target="_blank" rel="noopener noreferrer">liuhuadai@zju.edu.cn</a>) if you have any questions or suggestions!</p><p>

---

Tranlated By <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">Open Ai Tx</a> | Last indexed: 2026-04-20

---</p>

</div>

<div class="original-link">

<strong>Original README:</strong> <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/README.md" target="_blank" rel="noopener noreferrer">View on GitHub</a>

</div>

</div>

<div class="footer">

<p>Translated by <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">OpenAiTx</a> |

Last updated: 2026-04-20

</div>

</body>

</html>