ThinkSound

🌐 English | 简体中文 | 繁體中文 | Español | Français | 日本語

Jika Anda merasa proyek ini bermanfaat,

mohon berikan bintang ⭐ di GitHub!

Tata letak repositori

Repositori ThinkSound di GitHub ini menyimpan dua proyek terkait pada cabang yang terpisah:

| Cabang | Proyek | Dokumentasi |

|--------|--------|----------------|

| master | ThinkSound (NeurIPS 2025) — generasi Any2Audio terpadu dengan flow matching berpandu CoT | File ini: README.md |

| prismaudio | PrismAudio — pekerjaan lanjutan (ICLR 2026) pada video-ke-audio dengan CoT-RL multi-dimensi | README.md pada cabang prismaudio |

Untuk ThinkSound, gunakan cabang master (README ini). Untuk PrismAudio, checkout prismaudio dan ikuti README.md di sana.

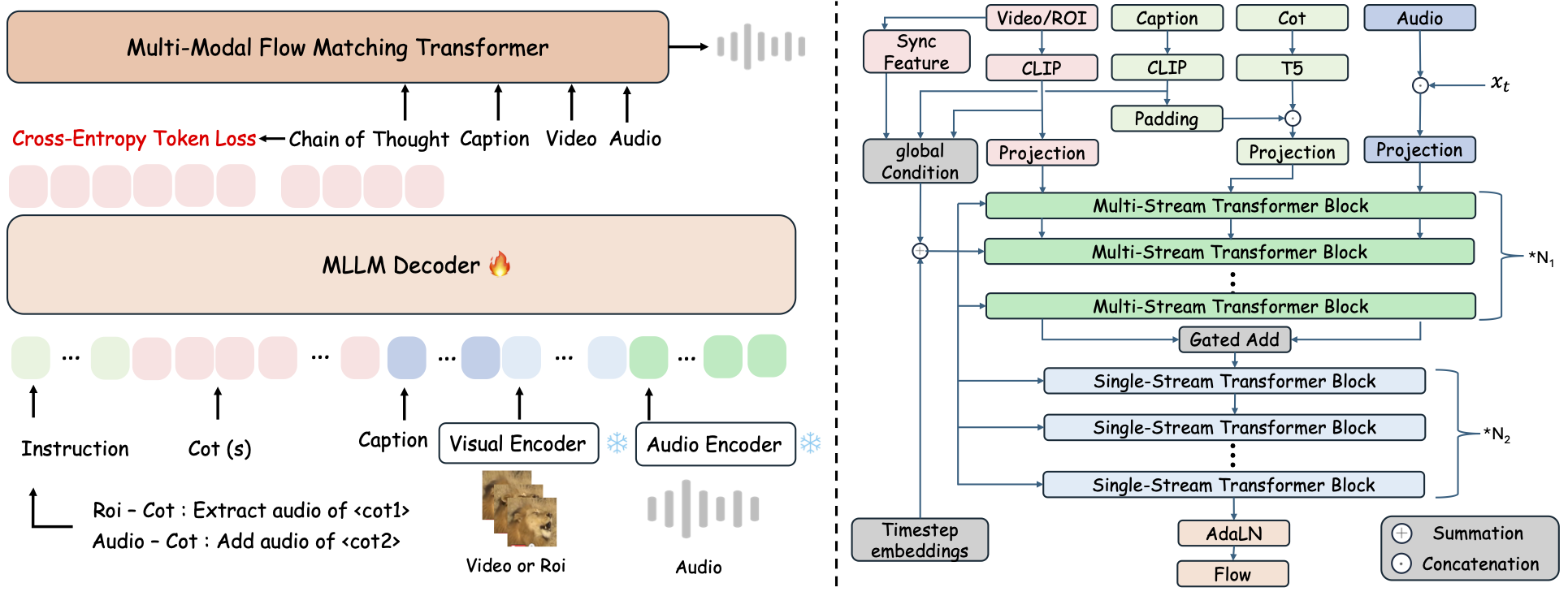

ThinkSound adalah kerangka generasi Any2Audio terpadu dengan flow matching berpandu Chain-of-Thought (CoT) reasoning.

Implementasi PyTorch untuk generasi dan pengeditan audio multimodal: menghasilkan atau mengedit audio dari video, teks, dan audio, didukung oleh reasoning bertahap dari Multimodal Large Language Models (MLLMs).

📰 Berita

- 2026.03.24 🔥 PrismAudio dirilis di repo yang sama pada cabang

prismaudio— lihatREADME.mddi sana untuk pengaturan dan model. - 2026.01.26 🎉 PrismAudio diterima di Konferensi Utama ICLR 2026 (kode/dokumen di

prismaudio). - 2025.11.25 🔥 Demo PrismAudio Online sudah aktif.

- 2025.11.25 🔥 Makalah PrismAudio di arXiv — CoT-RL multi-dimensi untuk video-ke-audio.

- 2025.09.19 🎉 ThinkSound diterima di Konferensi Utama NeurIPS 2025!

- 2025.09.01 Dataset AudioCoT kami kini open-source dan tersedia di Hugging Face!

- 2025.07.17 🧠 Finetuning diaktifkan: kode pelatihan dan finetuning kini tersedia publik, lengkap dengan instruksi penggunaan jelas untuk membantu Anda menyesuaikan dan memperluas ThinkSound dengan data sendiri.

- 2025.07.15 📦 Instalasi dan kemudahan penggunaan disederhanakan: dependensi di PyPI untuk setup lintas platform yang mudah; skrip Windows

.batmengotomasi pembuatan environment dan menjalankan skrip. - 2025.07.08 🔧 Update besar: model lebih ringan dan optimalisasi penggunaan memori dan GPU, kini mendukung generasi audio throughput tinggi secara skala besar!

- 2025.07.01 Demo online di Hugging Face Spaces dan ModelScope untuk pengalaman interaktif!

- 2025.07.01 Rilis skrip inferensi dan antarmuka web;

- 2025.06 Makalah ThinkSound dirilis di arXiv!

- 2025.06 Demo Online sudah aktif - coba sekarang!

Lanjutan: PrismAudio (repo yang sama, cabang prismaudio)

PrismAudio adalah penerus ThinkSound (ICLR 2026), dikembangkan dengan nama baru namun tetap disimpan di repositori ini pada branch prismaudio. Instalasi, checkpoint, dan sitasi tersedia di README.md pada branch tersebut.

👉 git checkout prismaudio atau buka branch tersebut di GitHub.

🚀 Fitur

- Any2Audio: Hasilkan audio dari berbagai modalitas — video, teks, audio, atau kombinasi keduanya.

- Video-to-Audio SOTA: Mencapai hasil terbaik pada berbagai tolok ukur V2A.

- CoT-Driven Reasoning: Penalaran Chain-of-Thought untuk generasi audio komposisional dan dapat dikontrol melalui MLLM.

- Interactive Object-centric Editing: Perbaiki atau edit kejadian suara tertentu dengan mengklik objek visual atau menggunakan instruksi teks.

- Unified Framework: Satu model dasar mendukung generasi, pengeditan, dan alur kerja interaktif.

✨ Ikhtisar Metode

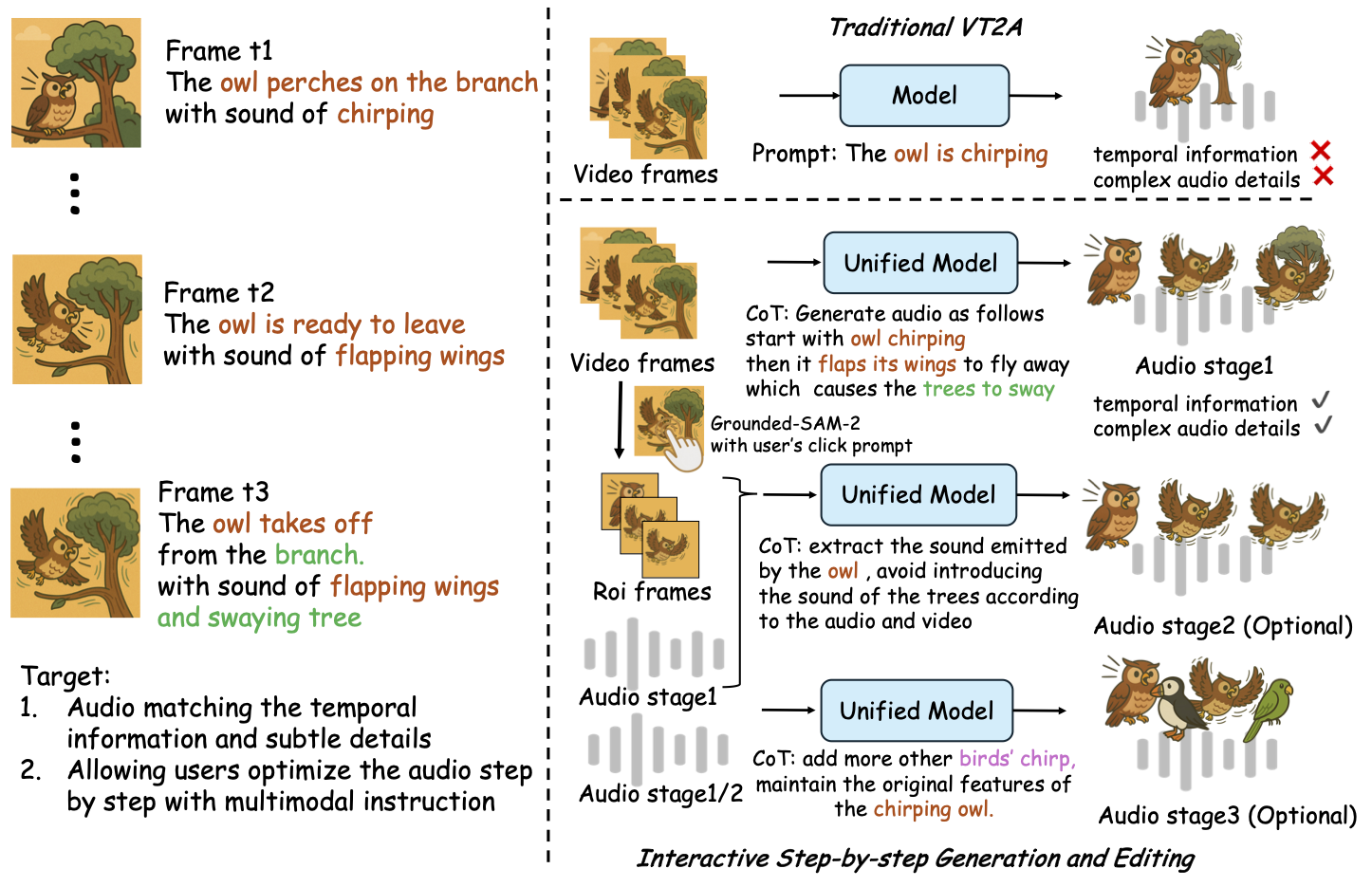

ThinkSound membagi proses generasi dan pengeditan audio menjadi tiga tahap interaktif, semuanya dipandu oleh penalaran Chain-of-Thought (CoT) berbasis MLLM:

- Foley Generation: Menghasilkan lanskap suara dasar yang selaras secara semantik dan temporal dari video.

- Object-Centric Refinement: Memperbaiki atau menambah suara untuk objek yang ditentukan pengguna melalui klik atau area di video.

- Targeted Audio Editing: Memodifikasi audio yang dihasilkan menggunakan instruksi bahasa alami tingkat tinggi.

⚡ Mulai Cepat

Persiapan Lingkungan:

# ThinkSound code: branch master. PrismAudio: clone with -b prismaudio (see README.md on that branch).

git clone -b master https://github.com/liuhuadai/ThinkSound.git

cd ThinkSound

conda create -n thinksound python=3.10

conda activate thinksound

pip install thinksound

conda install -y -c conda-forge 'ffmpeg<7'

Download pretrained weights https://huggingface.co/liuhuadai/ThinkSound to Directory ckpts/

model weights can be also downloaded from https://www.modelscope.cn/models/iic/ThinkSound

git lfs install

git clone https://huggingface.co/liuhuadai/ThinkSound ckpts

To improve inference and training speed, you may optionally install a FlashAttention backend compatible with your system and PyTorch version.

✅ Tips Windows:

Pengguna Windows dapat langsung menjalankan setup_windows.bat (atau klik dua kali) untuk secara otomatis membuat environment conda, menginstal semua dependensi (termasuk FFmpeg), dan mengunduh model pra-latih — tanpa perlu pengaturan manual.

Pastikancondadangitsudah terinstal dan tersedia di PATH sistem Anda sebelum menjalankan skrip.

▶️ Jalankan Demo

#### Linux/macOS

chmod +x scripts/demo.sh

./scripts/demo.sh <CoT description> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Anda dapat menggunakan skrip <code>.bat</code> yang disediakan sebagai gantinya:</p><pre><code class="language-bash">.\scripts\demo.bat <path-to-your-demo-video> <title> <CoT description> [use-half]</code></pre>

<strong>Catatan:</strong></p><ul><li><code><path-to-your-demo-video></code>: Jalur ke satu video</li>

<li><code>[use-half]</code> (opsional): Tambahkan use-half di akhir untuk mengaktifkan ekstraksi fitur presisi setengah.</li></p><p></ul>---</p><h3>📦 Inferensi Batch</h3></p><p>#### <strong>Linux/macOS</strong></p><pre><code class="language-bash">chmod +x scripts/eval_batch.sh

./scripts/eval_batch.sh <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Gunakan skrip <code>.bat</code> yang setara:</p><pre><code class="language-bash">.\scripts\eval_batch.bat <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

<strong>Catatan:</strong></p><ul><li><code><video_path></code>: Jalur ke direktori root yang berisi semua video .mp4 yang akan diproses (semua video harus berdurasi sama).</li>

<li><code><csv_path></code>: File CSV dengan prompt teks untuk setiap video (lihat <code>demo_test.csv</code> untuk formatnya).</li>

<li><code><save_path></code> (opsional): Tempat untuk menyimpan audio yang dihasilkan. Default ke <code>results/features</code>.</li>

<li><code>[use-half]</code> (opsional): Tambahkan use-half di akhir untuk mengaktifkan ekstraksi fitur presisi setengah.</li></p><p></ul>---</p><h3>Penggunaan Antarmuka Web</h3></p><p>Untuk pengalaman interaktif, jalankan antarmuka web Gradio:</p><pre><code class="language-bash">python app.py</code></pre>

<h2>🏋️ Melatih Model</h2></p><p>Lihat <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/docs/Training.md" target="_blank" rel="noopener noreferrer"><code>Training.md</code></a></p><hr></p><h2>📄 Lisensi</h2></p><p>Proyek ini dirilis di bawah Lisensi Apache 2.0.</p><blockquote><strong>Catatan:</strong></blockquote>

<blockquote>Kode, model, dan dataset ini <strong>hanya untuk tujuan penelitian dan pendidikan</strong>.</blockquote>

<blockquote><strong>Penggunaan komersial TIDAK diperbolehkan.</strong></blockquote>

<blockquote>Untuk lisensi komersial, silakan hubungi penulis.</blockquote></p><p><strong>📦 Komponen Pihak Ketiga</strong></p><ul><li><strong>Stable Audio Open VAE</strong> (oleh Stability AI):</li>

</ul>Repositori ini menyertakan VAE yang telah di-fine-tune dari <a href="https://huggingface.co/stabilityai/stable-audio-open-1.0/" target="_blank" rel="noopener noreferrer">Stable Audio Open</a>, berlisensi di bawah <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/./third_party/LICENSE_StabilityAI.md" target="_blank" rel="noopener noreferrer">Stability AI Community License</a>.

<strong>Penggunaan dan redistribusi komersial memerlukan izin sebelumnya dari Stability AI.</strong></p><ul><li>📘 <strong>Semua kode dan model lainnya</strong> dirilis di bawah Lisensi Apache 2.0.</li></p><p></ul>---</p><h2>Penghargaan</h2></p><p>Terima kasih banyak kepada:</p><ul><li><strong>stable-audio-tools</strong> (oleh Stability AI):</li>

</ul>Telah menyediakan kerangka kerja yang mudah digunakan untuk generasi audio, serta modul VAE dan bobotnya.

<ul><li><strong>MMAudio</strong>:</li>

</ul>Untuk implementasi backbone MM-DiT di domain audio.</p><hr></p><h2>📖 Sitasi</h2></p><p>Jika Anda merasa proyek kami bermanfaat untuk penelitian atau pekerjaan Anda, mohon sitasi makalah kami:</p><pre><code class="language-bibtex">@misc{liu2025thinksoundchainofthoughtreasoningmultimodal,

title={ThinkSound: Chain-of-Thought Reasoning in Multimodal Large Language Models for Audio Generation and Editing},

author={Huadai Liu and Jialei Wang and Kaicheng Luo and Wen Wang and Qian Chen and Zhou Zhao and Wei Xue},

year={2025},

eprint={2506.21448},

archivePrefix={arXiv},

primaryClass={eess.AS},

url={https://arxiv.org/abs/2506.21448},

}

@misc{liu2025prismaudiodecomposedchainofthoughtsmultidimensional,

title={PrismAudio: Decomposed Chain-of-Thoughts and Multi-dimensional Rewards for Video-to-Audio Generation},

author={Huadai Liu and Kaicheng Luo and Wen Wang and Qian Chen and Peiwen Sun and Rongjie Huang and Xiangang Li and Jieping Ye and Wei Xue},

year={2025},

eprint={2511.18833},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2511.18833},

}</code></pre></p><hr></p><h2>📬 Contact</h2></p><p>

✨ Feel free to <a href="https://github.com/liuhuadai/ThinkSound/issues" target="_blank" rel="noopener noreferrer">open an issue</a> or contact us via email (<a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/mailto:liuhuadai@zju.edu.cn" target="_blank" rel="noopener noreferrer">liuhuadai@zju.edu.cn</a>) if you have any questions or suggestions!</p><p>

---

Tranlated By <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">Open Ai Tx</a> | Last indexed: 2026-04-20

---</p>

</div>

<div class="original-link">

<strong>Original README:</strong> <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/README.md" target="_blank" rel="noopener noreferrer">View on GitHub</a>

</div>

</div>

<div class="footer">

<p>Translated by <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">OpenAiTx</a> |

Last updated: 2026-04-20

</div>

</body>

</html>