ThinkSound

🌐 Englisch | 简体中文 | 繁體中文 | Spanisch | Französisch | Japanisch

Wenn Sie dieses Projekt nützlich finden,

würden wir uns sehr über einen Stern ⭐ auf GitHub freuen!

Repository-Layout

Dieses ThinkSound GitHub-Repository beherbergt zwei verwandte Projekte auf separaten Branches:

| Branch | Projekt | Dokumentation |

|--------|---------|----------------|

| master | ThinkSound (NeurIPS 2025) — vereinheitlichte Any2Audio-Generierung mit CoT-gestütztem Flow Matching | Diese Datei: README.md |

| prismaudio | PrismAudio — Folgeprojekt (ICLR 2026) zu Video-zu-Audio mit multidimensionalem CoT-RL | README.md auf dem prismaudio Branch |

Für ThinkSound nutze den Branch master (dieses README). Für PrismAudio wechsle zu prismaudio und folge dort README.md.

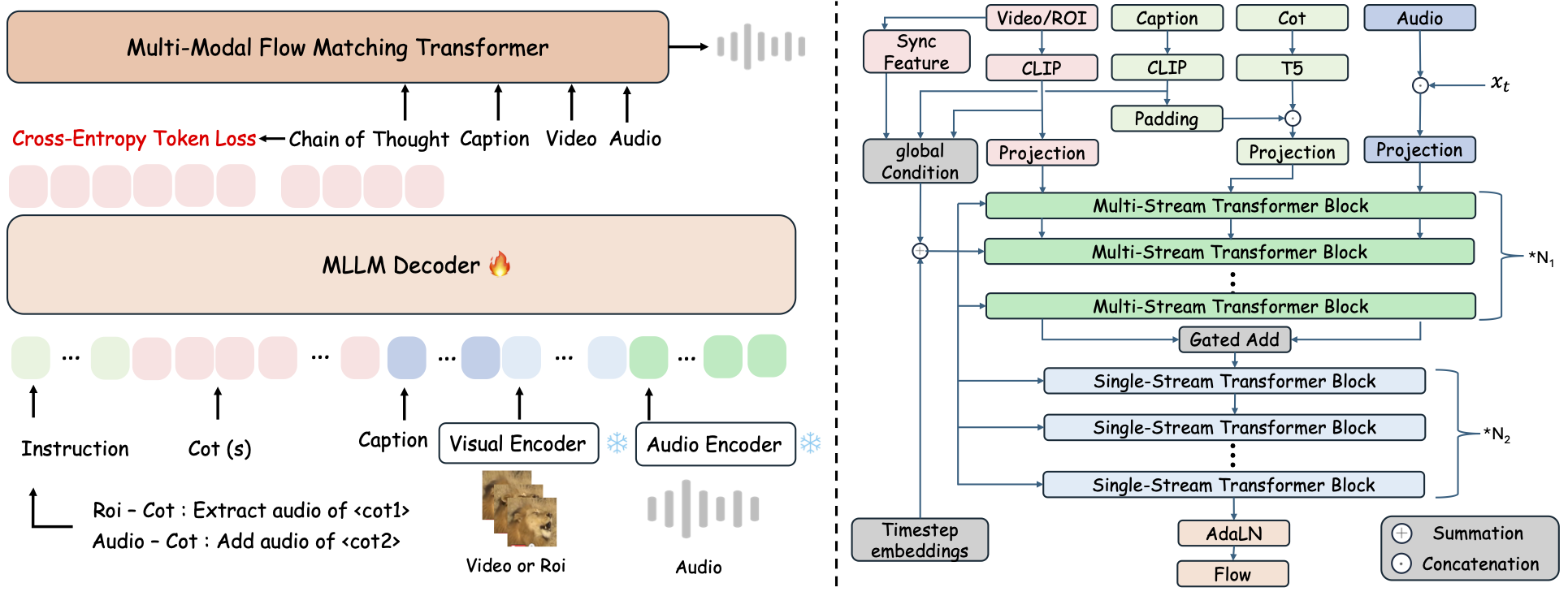

ThinkSound ist ein vereinheitlichter Any2Audio-Generierungsrahmen mit Flow Matching, geleitet durch Chain-of-Thought (CoT)-Reasoning.

PyTorch-Implementierung für multimodale Audio-Generierung und -Bearbeitung: Erzeuge oder bearbeite Audio aus Video, Text und Audio, unterstützt durch schrittweise Reasoning von Multimodalen Large Language Models (MLLMs).

📰 Neuigkeiten

- 2026.03.24 🔥 PrismAudio ist im selben Repo auf dem Branch

prismaudioveröffentlicht — sieheREADME.mddort für Setup und Modelle. - 2026.01.26 🎉 PrismAudio wurde auf der ICLR 2026 Main Conference angenommen (Code/Dokumentation auf

prismaudio). - 2025.11.25 🔥 Online PrismAudio Demo ist live.

- 2025.11.25 🔥 PrismAudio Paper auf arXiv — multidimensionales CoT-RL für Video-zu-Audio.

- 2025.09.19 🎉 ThinkSound wurde auf der NeurIPS 2025 Main Conference angenommen!

- 2025.09.01 Unser AudioCoT-Datensatz ist jetzt als Open Source verfügbar auf Hugging Face!

- 2025.07.17 🧠 Feintuning aktiviert: Trainings- und Feintuning-Code ist jetzt öffentlich verfügbar, mit klaren Anweisungen zur Nutzung, damit du ThinkSound mit eigenen Daten anpassen und erweitern kannst.

- 2025.07.15 📦 Vereinfachte Installation und Benutzerfreundlichkeit: Abhängigkeiten auf PyPI für einfache plattformübergreifende Einrichtung; Windows

.bat-Skripte automatisieren die Umgebungserstellung und das Ausführen von Skripten. - 2025.07.08 🔧 Großes Update: Modell verschlankt und optimierter Speicher- und GPU-Verbrauch, unterstützt jetzt hochskalierbare Audio-Generierung!

- 2025.07.01 Online-Demo auf Hugging Face Spaces und ModelScope für interaktives Erlebnis!

- 2025.07.01 Veröffentlicht Inferenz-Skripte und Weboberfläche;

- 2025.06 ThinkSound Paper auf arXiv veröffentlicht!

- 2025.06 Online Demo ist live – jetzt ausprobieren!

Folgeprojekt: PrismAudio (selbes Repo, prismaudio Branch)

PrismAudio ist der Nachfolger von ThinkSound (ICLR 2026), der unter neuem Namen entwickelt wurde, aber weiterhin in diesem Repository auf dem Branch prismaudio geführt wird. Installation, Checkpoints und Zitation befinden sich in README.md auf diesem Branch.

👉 git checkout prismaudio oder den Branch auf GitHub öffnen.

🚀 Funktionen

- Any2Audio: Erzeugt Audio aus beliebigen Modalitäten — Video, Text, Audio oder deren Kombinationen.

- Video-to-Audio SOTA: Erreicht modernste Ergebnisse auf mehreren V2A-Benchmarks.

- CoT-gesteuertes Reasoning: Chain-of-Thought-Reasoning für kompositionelle und steuerbare Audiogenerierung mittels MLLMs.

- Interaktives objektzentriertes Editieren: Verfeinere oder bearbeite spezifische Klangereignisse durch Klicken auf visuelle Objekte oder mit Textanweisungen.

- Einheitliches Framework: Ein Foundation-Modell unterstützt Generierung, Bearbeitung und interaktiven Workflow.

✨ Methodenübersicht

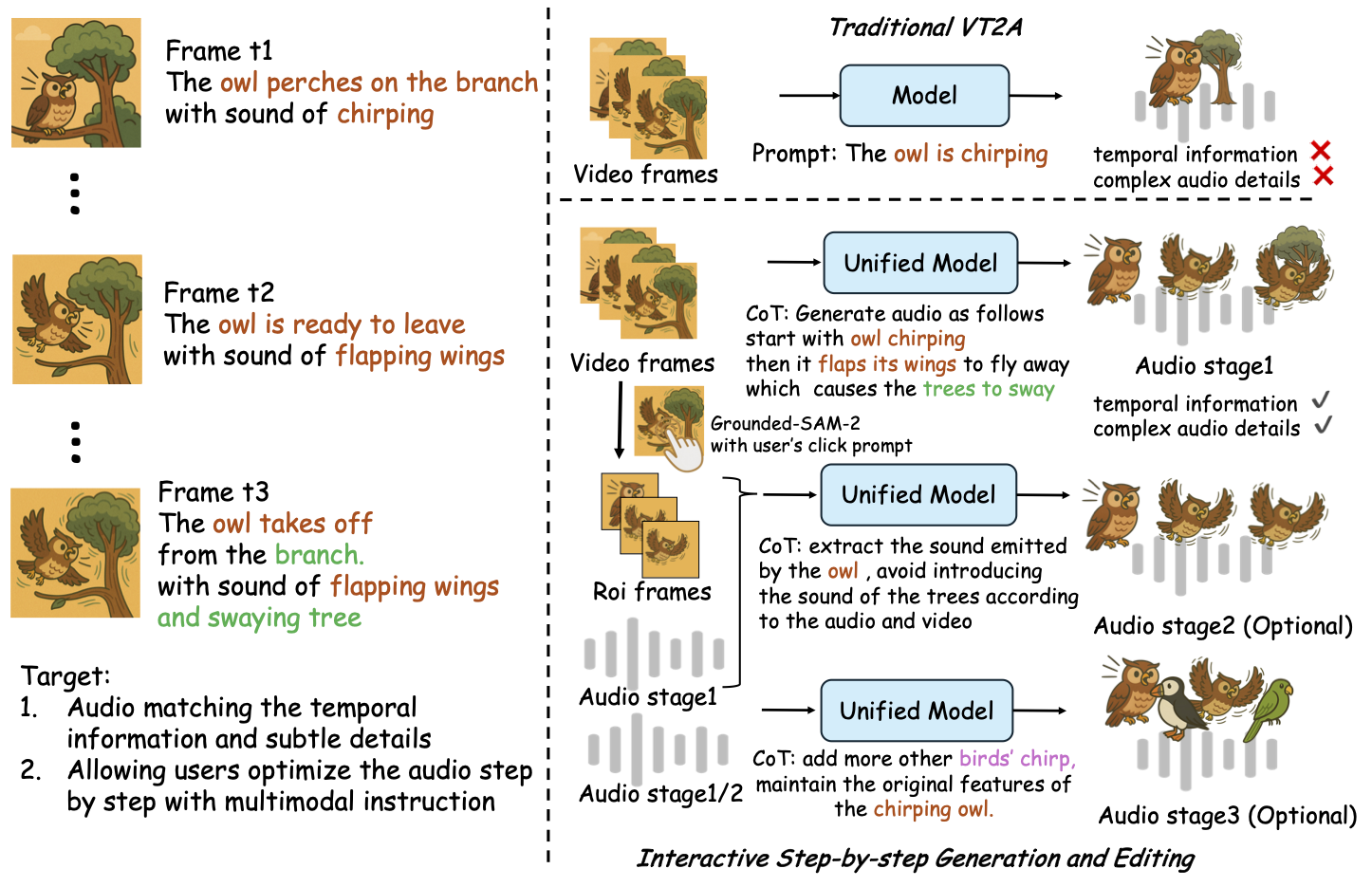

ThinkSound zerlegt die Audioerzeugung und -bearbeitung in drei interaktive Phasen, die alle durch MLLM-basiertes Chain-of-Thought-Reasoning (CoT) gesteuert werden:

- Foley-Erzeugung: Erstelle grundlegende, semantisch und zeitlich abgestimmte Klanglandschaften aus Videos.

- Objektzentrierte Verfeinerung: Verfeinere oder füge Sounds für vom Nutzer spezifizierte Objekte durch Klicks oder Regionen im Video hinzu.

- Gezieltes Audio-Editing: Modifiziere generiertes Audio mithilfe hochrangiger Anweisungen in natürlicher Sprache.

⚡ Schnellstart

Umgebungsvorbereitung:

# ThinkSound code: branch master. PrismAudio: clone with -b prismaudio (see README.md on that branch).

git clone -b master https://github.com/liuhuadai/ThinkSound.git

cd ThinkSound

conda create -n thinksound python=3.10

conda activate thinksound

pip install thinksound

conda install -y -c conda-forge 'ffmpeg<7'

Download pretrained weights https://huggingface.co/liuhuadai/ThinkSound to Directory ckpts/

model weights can be also downloaded from https://www.modelscope.cn/models/iic/ThinkSound

git lfs install

git clone https://huggingface.co/liuhuadai/ThinkSound ckpts

To improve inference and training speed, you may optionally install a FlashAttention backend compatible with your system and PyTorch version.

✅ Windows-Tipp:

Windows-Benutzer können einfach setup_windows.bat ausführen (oder doppelt anklicken), um automatisch die Conda-Umgebung zu erstellen, alle Abhängigkeiten zu installieren (einschließlich FFmpeg) und das vortrainierte Modell herunterzuladen — keine manuelle Einrichtung erforderlich.

Stellen Sie sicher, dasscondaundgitinstalliert sind und sich in Ihrem System-PATH befinden, bevor Sie das Skript ausführen.

▶️ Demo ausführen

#### Linux/macOS

chmod +x scripts/demo.sh

./scripts/demo.sh <CoT description> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Stattdessen können Sie das bereitgestellte <code>.bat</code>-Skript verwenden:</p><pre><code class="language-bash">.\scripts\demo.bat <path-to-your-demo-video> <title> <CoT description> [use-half]</code></pre>

<strong>Hinweis:</strong></p><ul><li><code><path-to-your-demo-video></code>: Der Pfad zu einem einzelnen Video</li>

<li><code>[use-half]</code> (optional): Fügen Sie use-half am Ende hinzu, um die Extraktion von Merkmalen mit halber Genauigkeit zu aktivieren.</li></p><p></ul>---</p><h3>📦 Stapel-Inferenz</h3></p><p>#### <strong>Linux/macOS</strong></p><pre><code class="language-bash">chmod +x scripts/eval_batch.sh

./scripts/eval_batch.sh <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

#### <strong>Windows</strong></p><p>Verwenden Sie das entsprechende <code>.bat</code>-Skript:</p><pre><code class="language-bash">.\scripts\eval_batch.bat <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre>

<strong>Hinweis:</strong></p><ul><li><code><video_path></code>: Pfad zum Stammverzeichnis, das alle zu verarbeitenden .mp4-Videos enthält (alle Videos müssen die gleiche Dauer haben).</li>

<li><code><csv_path></code>: Eine CSV-Datei mit Text-Inputs für jedes Video (siehe <code>demo_test.csv</code> für das Format).</li>

<li><code><save_path></code> (optional): Speicherort für die generierte Audiodatei. Standardmäßig <code>results/features</code>.</li>

<li><code>[use-half]</code> (optional): Fügen Sie use-half am Ende hinzu, um die Halbpräzisions-Feature-Extraktion zu aktivieren.</li></p><p></ul>---</p><h3>Nutzung der Weboberfläche</h3></p><p>Für eine interaktive Erfahrung starten Sie die Gradio-Weboberfläche:</p><pre><code class="language-bash">python app.py</code></pre>

<h2>🏋️ Modell trainieren</h2></p><p>Siehe <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/docs/Training.md" target="_blank" rel="noopener noreferrer"><code>Training.md</code></a></p><hr></p><h2>📄 Lizenz</h2></p><p>Dieses Projekt wird unter der Apache 2.0 Lizenz veröffentlicht.</p><blockquote><strong>Hinweis:</strong></blockquote>

<blockquote>Der Code, die Modelle und der Datensatz sind <strong>nur für Forschungs- und Ausbildungszwecke</strong> bestimmt.</blockquote>

<blockquote><strong>Kommerzielle Nutzung ist NICHT gestattet.</strong></blockquote>

<blockquote>Für kommerzielle Lizenzen wenden Sie sich bitte an die Autoren.</blockquote></p><p><strong>📦 Komponenten von Drittanbietern</strong></p><ul><li><strong>Stable Audio Open VAE</strong> (von Stability AI):</li>

</ul>Dieses Repository enthält ein feinabgestimmtes VAE von <a href="https://huggingface.co/stabilityai/stable-audio-open-1.0/" target="_blank" rel="noopener noreferrer">Stable Audio Open</a>, lizenziert unter der <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/./third_party/LICENSE_StabilityAI.md" target="_blank" rel="noopener noreferrer">Stability AI Community License</a>.

<strong>Kommerzielle Nutzung und Weiterverbreitung erfordern die vorherige Genehmigung von Stability AI.</strong></p><ul><li>📘 <strong>Alle anderen Codes und Modelle</strong> werden unter der Apache License 2.0 veröffentlicht.</li></p><p></ul>---</p><h2>Danksagungen</h2></p><p>Vielen Dank an:</p><ul><li><strong>stable-audio-tools</strong> (von Stability AI):</li>

</ul>Für die Bereitstellung eines einfach zu bedienenden Frameworks zur Audiogenerierung sowie des VAE-Moduls und der Gewichte.

<ul><li><strong>MMAudio</strong>:</li>

</ul>Für die Implementierung des MM-DiT-Backbones im Audio-Bereich.</p><hr></p><h2>📖 Zitierung</h2></p><p>Wenn Sie unser Projekt in Ihrer Forschung oder Arbeit nützlich finden, zitieren Sie bitte unsere Veröffentlichung:</p><pre><code class="language-bibtex">@misc{liu2025thinksoundchainofthoughtreasoningmultimodal,

title={ThinkSound: Chain-of-Thought Reasoning in Multimodal Large Language Models for Audio Generation and Editing},

author={Huadai Liu and Jialei Wang and Kaicheng Luo and Wen Wang and Qian Chen and Zhou Zhao and Wei Xue},

year={2025},

eprint={2506.21448},

archivePrefix={arXiv},

primaryClass={eess.AS},

url={https://arxiv.org/abs/2506.21448},

}

@misc{liu2025prismaudiodecomposedchainofthoughtsmultidimensional,

title={PrismAudio: Decomposed Chain-of-Thoughts and Multi-dimensional Rewards for Video-to-Audio Generation},

author={Huadai Liu and Kaicheng Luo and Wen Wang and Qian Chen and Peiwen Sun and Rongjie Huang and Xiangang Li and Jieping Ye and Wei Xue},

year={2025},

eprint={2511.18833},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2511.18833},

}</code></pre></p><hr></p><h2>📬 Contact</h2></p><p>

✨ Feel free to <a href="https://github.com/liuhuadai/ThinkSound/issues" target="_blank" rel="noopener noreferrer">open an issue</a> or contact us via email (<a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/mailto:liuhuadai@zju.edu.cn" target="_blank" rel="noopener noreferrer">liuhuadai@zju.edu.cn</a>) if you have any questions or suggestions!</p><p>

---

Tranlated By <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">Open Ai Tx</a> | Last indexed: 2026-04-20

---</p>

</div>

<div class="original-link">

<strong>Original README:</strong> <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/README.md" target="_blank" rel="noopener noreferrer">View on GitHub</a>

</div>

</div>

<div class="footer">

<p>Translated by <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">OpenAiTx</a> |

Last updated: 2026-04-20

</div>

</body>

</html>