থিঙ্কছাউণ্ড

🌐 ইংৰাজী | সৰল চাইনীজ | পৰম্পৰাগত চাইনীজ | স্পেনী | ফৰাচী | জাপানী

যদি আপুনি এই প্ৰকল্পটো উপযুক্ত বুলি ভাবে,

GitHub-ত এটা তৰাৰ ⭐ দান অনুকূল হ'ব!

ৰিপ'জিটৰীৰ বিন্যাস

এই ThinkSound GitHub ৰিপ’জিটৰীখনে দুটা সম্পৰ্কিত প্ৰজেক্টক পৃথক শাখাত সংৰক্ষণ কৰিছে:| শাখা | প্ৰজেক্ট | নথিপত্ৰ |

|--------|---------|----------------|

| master | ThinkSound (NeurIPS 2025) — একত্ৰিত Any2Audio উত্পাদন CoT-নির্দেশিত flow matching সহ | এই ফাইল: README.md |

| prismaudio | PrismAudio — video-to-audio ত multi-dimensional CoT-RL ৰ ওপৰত কৰা পৰৱৰ্তী কাম (ICLR 2026) | README.md prismaudio শাখাত |

ThinkSound-ৰ বাবে, master শাখা ব্যৱহাৰ কৰক (এই README)। PrismAudio-ৰ বাবে, prismaudio checkout কৰক আৰু তাত README.md অনুসৰণ কৰক।

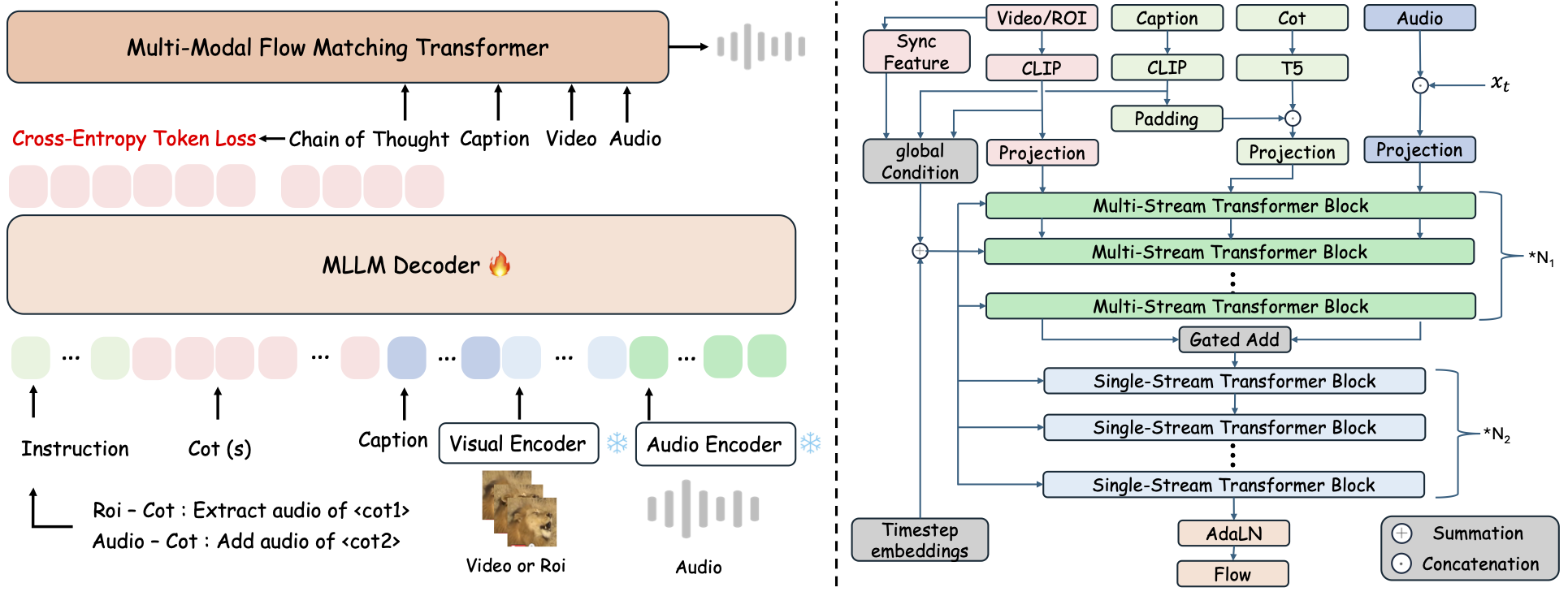

ThinkSound হৈছে এক একত্ৰিত Any2Audio উত্পাদন কাঠামো য’ত Chain-of-Thought (CoT) যুক্তি দ্বাৰা flow matching কৰা হয়।

মাল্টিম’ডেল অডিঅ’ জেনাৰেশ্বন আৰু সম্পাদনাৰ বাবে PyTorch ইমপ্লিমেন্টেশ্বন: ভিডিঅ’, টেক্সট আৰু অডিঅ’ৰ পৰা অডিঅ’ উত্পাদন বা সম্পাদনা কৰক, Multimodal Large Language Models (MLLMs)-ৰ step-by-step reasoning ৰ সহায়ত।

📰 বাতৰি

- ২০২৬.০৩.২৪ 🔥 PrismAudio এই একে ৰিপ’ত

prismaudioশাখাত মুক্তি পোৱা হৈছে — তাতREADME.mdচাওক setup আৰু মডেলৰ বাবে। - ২০২৬.০১.২৬ 🎉 PrismAudio ICLR 2026 Main Conference-লৈ গ্ৰহণ কৰা হৈছে (

prismaudioত code/docs)। - ২০২৫.১১.২৫ 🔥 অনলাইন PrismAudio ডেমো উপলব্ধ।

- ২০২৫.১১.২৫ 🔥 PrismAudio প্ৰবন্ধ arXiv-ত — ভিডিঅ’-টু-অডিঅ’ৰ বাবে multi-dimensional CoT-RL।

- ২০২৫.০৯.১৯ 🎉 ThinkSound NeurIPS 2025 Main Conference-লৈ গ্ৰহণ কৰা হৈছে!

- ২০২৫.০৯.০১ আমাৰ AudioCoT ডেটাসেট এতিয়া ওপেন-ছ’ৰ্চ আৰু Hugging Face-ত উপলব্ধ!

- ২০২৫.০৭.১৭ 🧠 Finetuning সক্ষম: এতিয়া পাব্লিকলি উপলব্ধ training আৰু finetuning code, আপোনাৰ নিজস্ব ডেটাত ThinkSound কাষ্টমাইজ আৰু এক্সটেণ্ড কৰিবলৈ স্পষ্ট নিৰ্দেশ।

- ২০২৫.০৭.১৫ 📦 সাধাৰণ ইনষ্টলেশ্বন আৰু ব্যৱহাৰযোগ্যতা: সহজ cross-platform setup-ৰ বাবে PyPI-ত dependencies; Windows

.batscript-এ environment creation আৰু script চলোৱা স্বচালিত কৰে। - ২০২৫.০৭.০৮ 🔧 ডাঙৰ আপডেট: মডেল lightweight কৰা আৰু স্মৃতি আৰু GPU ব্যৱহাৰ অপ্টিমাইজ, এতিয়া বৃহৎ পৰিসৰত high-throughput অডিঅ’ জেনাৰেশ্বন সমৰ্থন কৰে!

- ২০২৫.০৭.০১ অনলাইন ডেমো Hugging Face Spaces আৰু ModelScope-ত ইণ্টাৰেক্টিভ অভিজ্ঞতাৰ বাবে!

- ২০২৫.০৭.০১ inference script আৰু web interface মুক্তি দিয়া হৈছে;

- ২০২৫.০৬ ThinkSound প্ৰবন্ধ arXiv-ত মুক্তি দিয়া হৈছে!

- ২০২৫.০৬ অনলাইন ডেমো উপলব্ধ - এতিয়া চেষ্টা কৰক!

পৰৱৰ্তী কাম: PrismAudio (একেই ৰিপ’, prismaudio শাখা)

PrismAudio হৈছে ThinkSound (ICLR 2026)-ৰ উত্তৰসূৰী, যি এটা নতুন নামৰ অধীনত বিকাশ কৰা হৈছে, কিন্তু এই ৰেপ’জিটৰিত prismaudio শাখাত সংৰক্ষিত। ইনষ্টলেচন, চেকপইণ্ট, আৰু উদ্ধৃতি README.md সেই শাখাত-ত উপলব্ধ।

👉 git checkout prismaudio অথবা GitHub-ত সেই শাখা খোলক।

🚀 বৈশিষ্ট্যাবলী

- Any2Audio: যিকোনো মাধ্যমৰ পৰা অডিঅ’ সৃষ্টি কৰক — ভিডিঅ’, পাঠ, অডিঅ’, বা সেইবোৰৰ সংযোগ।

- Video-to-Audio SOTA: বহুবিধ V2A বেঞ্চমাৰ্কত উৎকৃষ্টতম ফলাফল লাভ কৰে।

- CoT-Driven Reasoning: MLLM-ৰ জৰিয়তে সংযোজিত আৰু নিয়ন্ত্রিত অডিঅ’ সৃষ্টি কাৰ্যৰ বাবে চেইন-অ’ফ-থট যুক্তি।

- Interactive Object-centric Editing: দৃশ্যমান বস্তুত ক্লিক কৰি বা পাঠ নিৰ্দেশনা ব্যৱহাৰ কৰি নিৰ্দিষ্ট শব্দ ইভেন্ট সম্পাদনা কৰক।

- Unified Framework: এটা মৌলিক মডেলে সৃষ্টি, সম্পাদনা, আৰু আন্তঃকৰ্মপদ্ধতি সমৰ্থন কৰে।

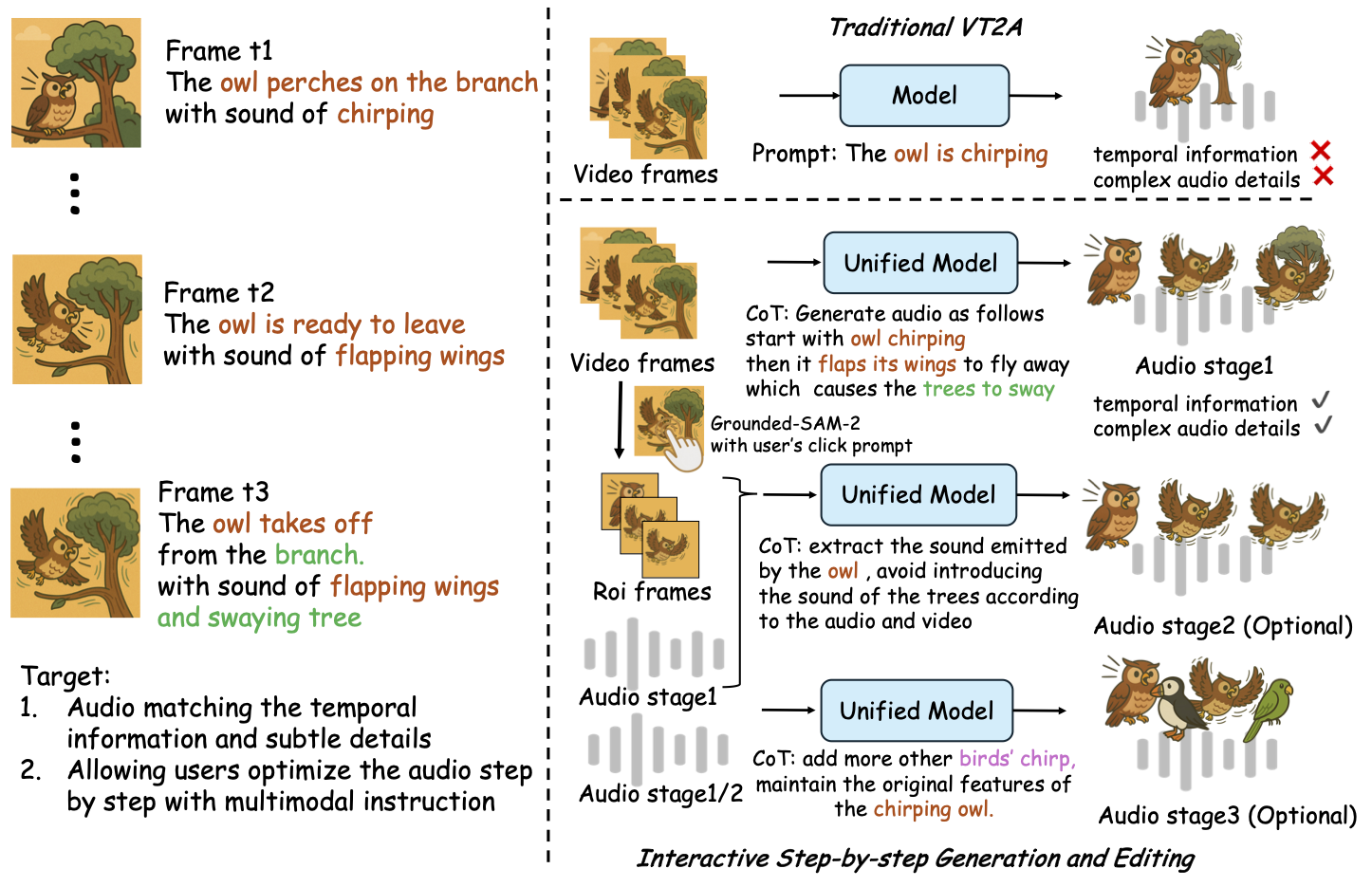

✨ পদ্ধতিৰ সংক্ষিপ্ত পৰিচয়

ThinkSound-এ অডিঅ’ সৃষ্টি আৰু সম্পাদনাক তিনিটা আন্তঃক্ৰিয়াশীল পৰ্যায়ত বিভক্ত কৰে, সকলো MLLM-ভিত্তিক চেইন-অ’ফ-থট (CoT) যুক্তিৰে নিয়ন্ত্রিত:

- Foley Generation: ভিডিঅ’ৰ পৰা মৌলিক, অৰ্থবোধক আৰু সময়ানুকূল শব্দৰ দৃশ্য সৃষ্টি কৰক।

- Object-Centric Refinement: ভিডিঅ’ত ক্লিক বা অঞ্চল নিৰ্বাচন কৰি ব্যৱহাৰকাৰী নিৰ্ধাৰিত বস্তুৰ বাবে শব্দ উন্নয়ন অথবা সংযোগ কৰক।

- Targeted Audio Editing: উচ্চ-স্তৰৰ প্ৰাকৃতিক ভাষা নিৰ্দেশনাৰ সহায়ত সৃষ্ট অডিঅ’ সম্পাদনা কৰক।

⚡ তৎক্ষণাত আৰম্ভ কৰক

পৰিবেশ প্রস্তুতি:

# ThinkSound code: branch master. PrismAudio: clone with -b prismaudio (see README.md on that branch).

git clone -b master https://github.com/liuhuadai/ThinkSound.git

cd ThinkSound

conda create -n thinksound python=3.10

conda activate thinksound

pip install thinksound

conda install -y -c conda-forge 'ffmpeg<7'

Download pretrained weights https://huggingface.co/liuhuadai/ThinkSound to Directory ckpts/

model weights can be also downloaded from https://www.modelscope.cn/models/iic/ThinkSound

git lfs install

git clone https://huggingface.co/liuhuadai/ThinkSound ckpts

To improve inference and training speed, you may optionally install a FlashAttention backend compatible with your system and PyTorch version.

✅ উইণ্ড'জ টিপ:

উইণ্ড'জ ব্যৱহাৰকাৰীসকলে সহজে setup_windows.bat চলাব পাৰে (অথবা ইয়াত ডাবল-ক্লিক কৰিব পাৰে) যাতে স্বয়ংক্ৰিয়ভাৱে কন্ডা পৰিৱেশ সৃষ্টি হয়, সকলো নিৰ্ভৰতা (FFmpeg সহ) সংস্থাপন হয়, আৰু প্ৰি-ট্ৰেইনড মডেল ডাউনলোড হয় — কোনো হস্তচালিত সংস্থাপন প্ৰয়োজন নহয়।

স্ক্ৰিপ্ট চলোৱাৰ আগতে আপোনাৰ ব্যৱস্থাতcondaআৰুgitসংস্থাপন কৰা আৰু PATH-ত উপলব্ধ হোৱা নিশ্চিত কৰক।

▶️ ডেম’ চলাওক

#### লিনাক্স/ম্যাক’এস

chmod +x scripts/demo.sh

./scripts/demo.sh <CoT description> [use-half]</code></pre></p><p>#### <strong>Windows</strong></p><p>আপুনি ইয়াৰ বিপৰীতে প্ৰদান কৰা <code>.bat</code> স্ক্ৰিপ্ট ব্যৱহাৰ কৰিব পাৰে:</p><pre><code class="language-bash">.\scripts\demo.bat <path-to-your-demo-video> <title> <CoT description> [use-half]</code></pre></p><p><strong>টোকা:</strong></p><ul><li><code><path-to-your-demo-video></code>: এটা ভিডিঅ'ৰ পথ</li>

<li><code>[use-half]</code> (ঐচ্ছিক): আধা প্ৰেছিছন বৈশিষ্ট্য এক্সট্ৰাকশ্যন সক্ৰিয় কৰিবলৈ শেষত use-half যোগ কৰক।</li></p><p></ul>---</p><h3>📦 বেটচ ইনফাৰেন্স</h3></p><p>#### <strong>Linux/macOS</strong></p><pre><code class="language-bash">chmod +x scripts/eval_batch.sh

./scripts/eval_batch.sh <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre></p><p>#### <strong>উইণ্ডোজ</strong></p><p>সমান <code>.bat</code> স্ক্ৰিপ্ট ব্যৱহাৰ কৰক:</p><pre><code class="language-bash">.\scripts\eval_batch.bat <video_path> <csv_path> <save_path (optional)> [use-half]</code></pre></p><p><strong>টোকা:</strong></p><ul><li><code><video_path></code>: প্ৰক্ৰিয়া কৰিবলৈ সকলো .mp4 ভিডিঅ' থকা মূল ডাইৰেক্টৰীৰ পথ (সকলো ভিডিঅ'ৰ সময়সীমা সমান হ'ব লাগিব).</li>

<li><code><csv_path></code>: প্ৰত্যেক ভিডিঅ'ৰ বাবে টেক্সট প্ৰম্পট থকা এটা CSV ফাইল (<code>demo_test.csv</code>ত ফৰ্মেট চাওক).</li>

<li><code><save_path></code> (ঐচ্ছিক): নিৰ্মিত অডিঅ' সংৰক্ষণ কৰাৰ স্থান. ডিফল্ট <code>results/features</code>।</li>

<li><code>[use-half]</code> (ঐচ্ছিক): আধা প্ৰিসিশন ফিচাৰ এক্সট্ৰাকচন সক্ৰিয় কৰিবলৈ শেষত use-half যোগ কৰক।</li></p><p></ul>---</p><h3>ৱেব ইণ্টাৰফেছ ব্যৱহাৰ</h3></p><p>ইন্টাৰেক্টিভ অভিজ্ঞতাৰ বাবে, Gradio ৱেব ইণ্টাৰফেছ আৰম্ভ কৰক:</p><pre><code class="language-bash">python app.py</code></pre></p><h2>🏋️ মডেলটো প্ৰশিক্ষণ কৰক</h2></p><p><a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/docs/Training.md" target="_blank" rel="noopener noreferrer"><code>Training.md</code></a> চাওক</p><hr></p><h2>📄 লাইচেঞ্চ</h2></p><p>এই প্ৰকল্পটো Apache 2.0 লাইচেঞ্চত মুক্তি দিয়া হৈছে।</p><blockquote><strong>টোকা:</strong></blockquote>

<blockquote>কোড, মডেল, আৰু ডেটাছেট <strong>গৱেষণা আৰু শৈক্ষিক উদ্দেশ্যৰ বাবে মাত্ৰ</strong>।</blockquote>

<blockquote><strong>বাণিজ্যিক ব্যৱহাৰ অনুমতি নাই।</strong></blockquote>

<blockquote>বাণিজ্যিক লাইচেঞ্চৰ বাবে, অনুগ্ৰহ কৰি লেখকসকলৰ সৈতে যোগাযোগ কৰক।</blockquote></p><p><strong>📦 তৃতীয় পক্ষীয় উপাদানসমূহ</strong></p><ul><li><strong>Stable Audio Open VAE</strong> (Stability AI দ্বাৰা):</li>

</ul>এই ৰিপজিটৰীত <a href="https://huggingface.co/stabilityai/stable-audio-open-1.0/" target="_blank" rel="noopener noreferrer">Stable Audio Open</a>ৰ পৰা ফাইন-টিউন কৰা VAE অন্তর্ভুক্ত আছে, <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/./third_party/LICENSE_StabilityAI.md" target="_blank" rel="noopener noreferrer">Stability AI Community License</a>ত লাইচেঞ্চ কৰা।

<strong>বাণিজ্যিক ব্যৱহাৰ আৰু পুনৰ বিতৰণ Stability AIৰ পূৰ্বৰ অনুমতিৰ প্ৰয়োজন।</strong></p><ul><li>📘 <strong>অন্য সকলো কোড আৰু মডেল</strong> Apache License 2.0ত মুক্তি দিয়া হৈছে।</li></p><p></ul>---</p><h2>কৃতজ্ঞতা</h2></p><p>অসংখ্য ধন্যবাদ:</p><ul><li><strong>stable-audio-tools</strong> (Stability AI দ্বাৰা):</li>

</ul>অডিঅ' জেনাৰেশ্যনৰ বাবে সহজে ব্যৱহাৰ কৰিব পৰা ফ্ৰেমৱৰ্ক, লগতে VAE মডিউল আৰু ওজনৰ বাবে।

<ul><li><strong>MMAudio</strong>:</li>

</ul>অডিঅ' ডোমেইনত MM-DiT ব্যাকবোনৰ বাস্তৱায়নৰ বাবে।</p><hr></p><h2>📖 উদ্ধৃতি</h2></p><p>আপুনি যদি আপোনাৰ গৱেষণা বা কামত আমাৰ প্ৰকল্পটো উপকাৰী বুলি পাইছে, অনুগ্ৰহ কৰি আমাৰ কাগজখন উদ্ধৃতি কৰক:</p><pre><code class="language-bibtex">@misc{liu2025thinksoundchainofthoughtreasoningmultimodal,

title={ThinkSound: Chain-of-Thought Reasoning in Multimodal Large Language Models for Audio Generation and Editing},

author={Huadai Liu and Jialei Wang and Kaicheng Luo and Wen Wang and Qian Chen and Zhou Zhao and Wei Xue},

year={2025},

eprint={2506.21448},

archivePrefix={arXiv},

primaryClass={eess.AS},

url={https://arxiv.org/abs/2506.21448},

}

@misc{liu2025prismaudiodecomposedchainofthoughtsmultidimensional,

title={PrismAudio: Decomposed Chain-of-Thoughts and Multi-dimensional Rewards for Video-to-Audio Generation},

author={Huadai Liu and Kaicheng Luo and Wen Wang and Qian Chen and Peiwen Sun and Rongjie Huang and Xiangang Li and Jieping Ye and Wei Xue},

year={2025},

eprint={2511.18833},

archivePrefix={arXiv},

primaryClass={cs.SD},

url={https://arxiv.org/abs/2511.18833},

}</code></pre></p><hr></p><h2>📬 Contact</h2></p><p>

✨ Feel free to <a href="https://github.com/liuhuadai/ThinkSound/issues" target="_blank" rel="noopener noreferrer">open an issue</a> or contact us via email (<a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/mailto:liuhuadai@zju.edu.cn" target="_blank" rel="noopener noreferrer">liuhuadai@zju.edu.cn</a>) if you have any questions or suggestions!</p><p>

---

Tranlated By <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">Open Ai Tx</a> | Last indexed: 2026-04-20

---</p>

</div>

<div class="original-link">

<strong>Original README:</strong> <a href="https://raw.githubusercontent.com/FunAudioLLM/ThinkSound/master/README.md" target="_blank" rel="noopener noreferrer">View on GitHub</a>

</div>

</div>

<div class="footer">

<p>Translated by <a href="https://github.com/OpenAiTx/OpenAiTx" target="_blank" rel="noopener noreferrer">OpenAiTx</a> |

Last updated: 2026-04-20

</div>

</body>

</html>